#OpenAI

ChatGPT 开始卖广告了,但 OpenAI 真正的野心在语音

5 月 7 日,OpenAI 在英、巴等五国启动 ChatGPT 广告内测,并推出三款具备 GPT-5 级推理能力的实时语音模型。广告业务强调隐私与回答独立性,旨在探索免费用户变现路径。新语音模型则支持复杂任务操作,加速企业付费场景落地。此举标志 OpenAI 从技术验证转向商业模式规模化,证明 AI 产品可兼顾用户体验与多元盈利,为行业商业化提供了关键风向标。

ChatGPT Images 2.0 在印度受热捧,但目前在其他地方尚未大获成功

虽然 OpenAI 声称印度成为 ChatGPT Images 2.0 最大用户市场,但第三方数据显示全球增长实则温和,下载量仅增 11%,日活和流量涨幅约 1%。巴基斯坦、越南、印尼等新兴市场反而出现高达 79%的下载增长。印度用户主要将该功能用于个人表达场景,如风格化肖像、社交头像等,反映出 AI 图像工具在不同市场的落地方式存在差异。

OpenAI 亲口承认:GPT 被“哥布林”感染了,而且是自己训练出来的

OpenAI 承认 GPT-5.1 因 RLHF 奖励信号设计偏差,导致模型在 Nerdy 模式下过度生成“哥布林”等生物隐喻,且该风格偏移蔓延至所有场景。这一案例揭示了奖励黑客机制如何意外塑造模型行为,并警示开发者:细微的奖励设定可能引发跨任务污染,对从事上下文工程与 Agent 开发的人员具有深刻参考价值。

批评 Anthropic 限制 Mythos 后, OpenAI 也对 Cyber 实施访问限制

OpenAI 即将推出网络安全工具 Cyber ,采用限制性发布策略,要求用户提交资质审核。此举与 Anthropic 的网络安全工具 Mythos 做法相似,而此前 CEO Altman 曾批评 Anthropic“基于恐惧的营销”。 Cyber 具备渗透测试、漏洞识别与利用、恶意软件逆向工程等能力。 OpenAI 通过 TAC 系统验证防御人员身份。分析指出,网络安全工具一旦具备真实攻击能力,任何公司都难以彻底开放,各公司策略实则趋同,分歧更多体现在话术层面。

OpenAI 为免费 ChatGPT 用户默认启用营销 Cookie

OpenAI 更新隐私政策,将免费用户纳入站外营销追踪体系。新政策允许使用 Cookie 、设备 ID 及邮箱等有限信息在第三方平台推广产品并衡量广告转化效果。 OpenAI 明确表示不会将 ChatGPT 对话内容分享给广告商,但免费用户的相关设置默认开启,付费用户则默认关闭。用户可通过设置退出追踪。此次调整正值 OpenAI 探索商业化路径阶段,显示出其正从订阅制向更典型的互联网增长模式转型, ChatGPT 的私密属性正在发生变化。

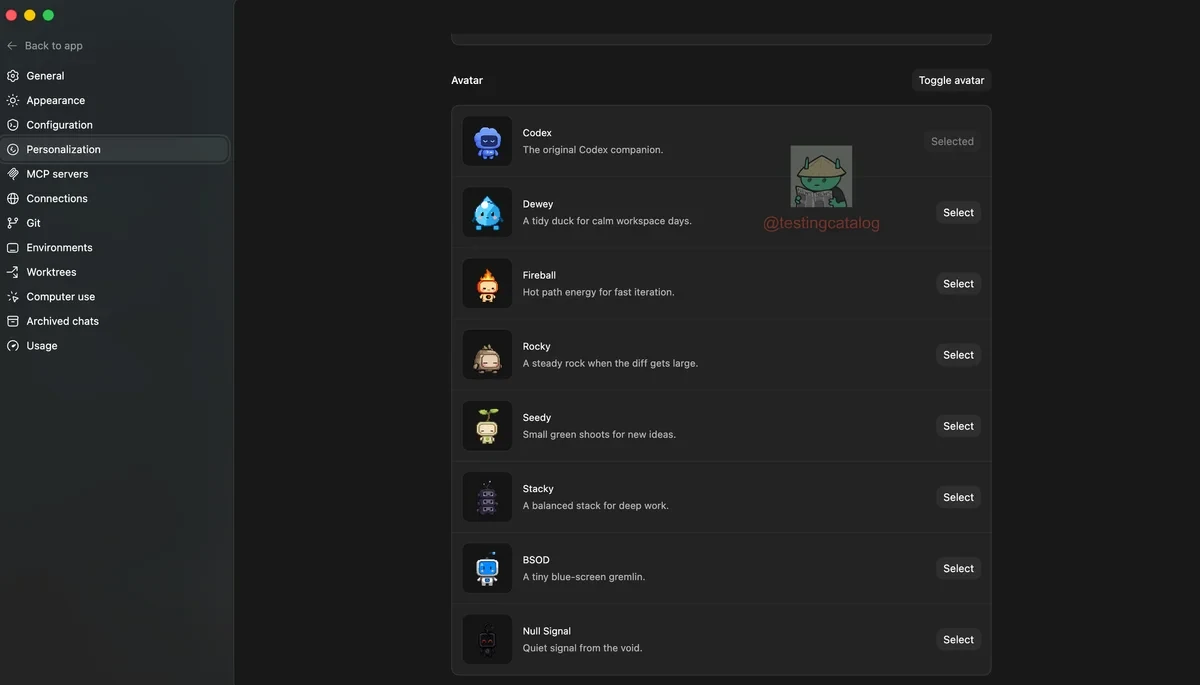

OpenAI 为 Codex 应用打造 8 个交互式 Avatar

OpenAI 正在为 Codex 测试 8 个可交互头像功能,用户可在编码时让可视化角色悬浮在屏幕上,以对话气泡形式显示回复。该功能可自由开关,支持自定义,采用像素可爱风格。配合此前推出的 Chronicle 屏幕记忆功能, Codex 正从纯代码工具转向具备人格外观、上下文记忆的桌面型智能体。这一变化代表行业趋势:编程助手不再只强调“写代码更快”,而是强调“持续陪伴开发者工作”,竞争点也从模型质量转向陪伴感与信任感。

OpenAI 升级 ChatGPT 图像生成模型

OpenAI 发布 ChatGPT Images 2.0 ,在图像细节控制和英文文字渲染上有显著提升,并支持灵活画幅比例。模型通过整合 ChatGPT 推理能力实现内容更精细、更完整的输出。但测试显示,在中文等多语言场景中表现仍不稳定。生成的中文往往只是视觉模仿,字符层面容易失真。当前英文用户已接近“能做成品”的门槛,而其他语言用户拿到的大多是风格化草稿。对中文用户而言,将其定位为灵感图、情绪板工具更为稳妥,直接产出可发布海报还为时尚早。

ChatGPT 新 Images 2.0 模型生成文本能力超乎预期

ChatGPT Images 2.0 大幅提升 AI 图像生成质量,尤其在文字渲染上取得突破,已能生成可直接使用的餐厅菜单等实用内容。技术层面虽未公开底层架构,但新版在指令遵循、细节保留及非拉丁文字处理上显著改进,并具备“思考能力”,支持联网搜索与多图生成复核。该模型标志着 AI 图像工具正从“演示型产品”向“生产型工具”转型,其核心价值不在于“画得更像”,而是“错得更少”,将推动 AI 图像在实际内容生产场景的落地应用。

ChatGPT 图像 2.0 全新发布

ChatGPT Images 2.0 发布,重点不再局限于画质提升,而是将图像生成推向更精确、可控的生产工具层面。核心改进包括:文字渲染更稳定、多语言支持更强、风格跨度更大、版式比例更灵活。模型不再满足于生成“看起来像那么回事”的图片,而是覆盖设计、广告、教育、出版等实际工作流场景,目标是从灵感工具升级为半成品生产工具。真正难的从来不是生成一张惊艳样片,而是稳定地产出一批能用的东西。