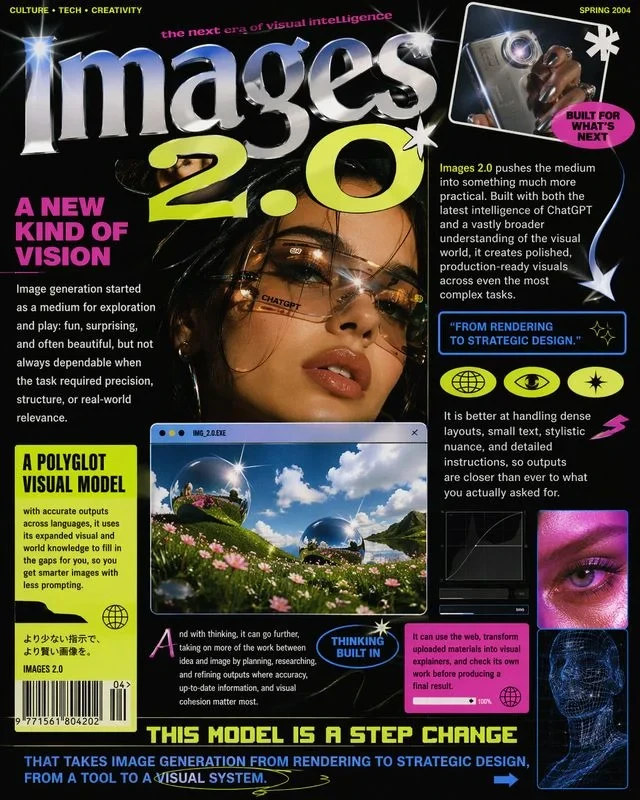

OpenAI 推出 ChatGPT Images 2.0 。细节更强,文字生成进步明显,但多语言仍不稳定

OpenAI 在本周二发布新一代图像生成模型 ChatGPT Images 2.0 ,面向全球 ChatGPT 和 Codex 用户开放,付费订阅者还能使用能力更强的版本。实际测试显示,这一模型在图像细节、版式控制和英文文字渲染上都有明显提升,已经能从一条提示词中同时生成多张图片,甚至做出整本学习手册一类的复杂内容。不过,它在英语之外的语言上仍有短板,尤其是中文这类非英文文本,离“可直接交付”还有距离。

图像模型每次迭代,都会重新点燃用户热情。原因也很直接。一旦社交平台出现可复制、可模仿的视觉玩法,使用量就会迅速抬升。去年, Google 推出 Nano Banana 模型后,用户批量上传自己的超写实玩偶形象,那一波传播就是典型案例。今年早些时候, ChatGPT Images 也曾因 AI 生成夸张漫画头像在社交媒体上走红。 OpenAI 这次更新,显然也瞄准了类似的传播效应。

这次变化的核心,在于 ChatGPT Images 2.0 能调用 ChatGPT 的“推理”能力。换句话说,它不再只是机械地从提示词里抓关键词生成图片,而是可以借助联网搜索获取较新的信息,并用更多中间步骤来组织输出。 OpenAI 也更新了模型的知识截止时间,最新到 2025 年 12 月。

这带来的直接结果,是生成内容更细,也更像“完整作品”而不是一张孤立图片。测试中,记者要求模型生成一张旧金山次日天气预报信息图,并附上适合当天安排的活动建议。生成结果不仅给出了与雨天相符的天气信息,还画出了 Ferry Building 、 Castro Theater 、 Painted Ladies 和 Transamerica Pyramid 等地标,视觉上已经接近一张可分享的城市资讯海报。

新模型的可控性也更高。用户现在可以在提示词里直接指定图片比例,范围从 3 : 1 的超宽画幅到 1 : 3 的纵向长图。这看上去像小改动,实际很实用。因为很多生成式图像的问题,不在“画不出来”,而在“画出来没法用”。比例自由度上来后,封面、海报、社交媒体长图这些场景就更顺手了。

英文文本渲染,是这次升级里最扎实的一部分。过去几年,不少主流图像模型一碰到文字就露怯。字母变形、单词拼错、莫名多出字符,几乎是行业通病。两年前, ChatGPT 甚至还很难把图上的标签写对。现在看, Images 2.0 在英文里的表现已经明显干净许多,复杂版面中的文字也更稳定。 Google 最近几轮 Nano Banana 的迭代,同样在强化这件事,说明“图像里把字写对”已经成了新一轮竞争焦点。

问题出在多语言。测试中,记者让 ChatGPT 生成一张 “Timothée Chalamet 中文粉丝风格拼贴海报”。结果从视觉上看相当热闹,里面有大量近似写实的明星照片,还有传统服饰、猫耳元素,以及饺子、珍珠奶茶、熊猫等常见文化符号,文本碎片超过 20 处,整体非常像社交平台上的饭制海报。

但当记者进一步追问“这些字写的是什么”时, ChatGPT 自己给出的解释却相当不留情面。它承认,图里大量文字是假中文,或者说是“半胡话式”的 AI 文本,只是被包装成了看起来像中文网络海报的样子,因此并不能完整翻译。模型还指出,其中一些区域混入了看起来像日文的字符,像清单卡片和右侧装饰线条那几处,基本属于“为了模仿东亚粉圈编辑风格而制造出来的无意义文本”,并不是准确句子。

这其实说明了一个很现实的问题。 ChatGPT Images 2.0 在英文世界里已经开始接近“能做成品”的门槛,但到了中文、印地语等语言环境,它更像一个视觉模仿器,而不是一个真正理解文字系统的排版工具。它会抓住风格信号,复制审美套路,也能生成很像那么回事的版面气质,但一到具体字符和语义层面,还是容易失真。

OpenAI 这次发布时提到,新模型支持包括中文和印地语在内的非英文文本输出。从能力定义上说,这话不算错。模型确实能生成这些语言的字符外观,也能在局部做出接近目标语言的文本质感。但从测试结果看,“支持”离“稳定可用”之间,差的不是一点点。对全球用户来说,这会直接影响落地体验。英文用户看到的是生产力工具,其他语言用户拿到的,很多时候仍是风格化草稿。