#AI 模型

扩散型大语言模型:文本生成范式的重大突破

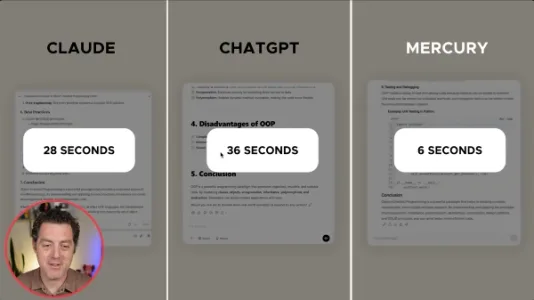

Inception Labs推出首个生产级扩散型大语言模型Mercury,突破自回归范式,采用“从粗到细”迭代生成,推理快10倍、成本降10倍;支持全局优化与任意顺序编辑,在代码生成中耗时仅为传统模型的1/6。

Stability AI 与 Arm 强强联手,让手机也跑得动 AI

Stability AI 与 Arm 合作,首次实现 Stable Audio Open 模型在手机端本地运行,仅靠 Arm CPU 即可秒级生成高质量音频,速度提升30倍。无需联网、不传数据,兼顾隐私、便携与实时创作,为视频、音乐、播客等创作者提供口袋里的音频工作室。

从数据科学到 AI,职业生涯的重要抉择

AI岗位激增(2025年1月达5000个),偏爱Python、云平台、深度学习与NLP技能,但数据科学家的评估能力、业务理解等优势可平滑迁移。不必急于转岗,更宜在现有工作中融合AI工具与思维,找准适配路径。

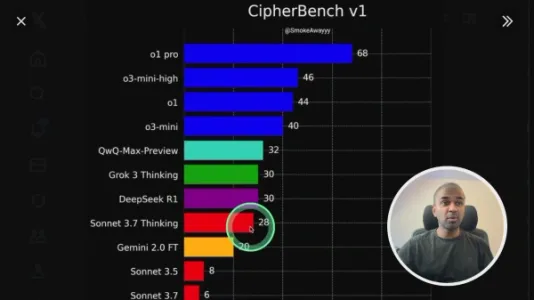

阿里巴巴通义千问 QwQ Max 推理能力超越 Claude 3.7

阿里通义千问QwQ Max预览版在CipherBench推理测试中超越Claude 3.7,与Grok 3、DeepSeek R1相当;AIME 2025数学题一次通过率达60%。采用Apache 2.0完全开源,支持多模态、工具调用,已免费上线Qwen Chat。

OpenAI 推出 GPT-4.5:更强大、更智能、更贴近人类的 AI 模型

OpenAI发布GPT-4.5研究预览版,在无监督学习上大幅突破:SimpleQA准确率达62.5%,幻觉率降至37.1%,显著优于GPT-4o与o3-mini;情感理解更细腻,创意与知识整合能力更强,交互更自然可信。

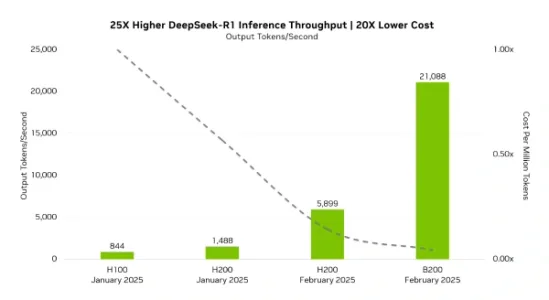

DeepSeek-R1 让 Blackwell 架构的性能大升级

英伟达推出TensorRT优化的FP4版DeepSeek-R1,运行于Blackwell架构时相较H100提升25倍收益、降低单Token成本20倍;MMLU测试达FP8版本99.8%精度,兼顾速度与准确率;FP4模型已开源至Hugging Face。

2025 年 12 款优秀的大语言模型

2025年12款主流大语言模型全景梳理:涵盖GPT-4o、Gemini、Claude、Llama、Mistral等,突出多模态、开源、轻量部署、强推理等差异化能力,兼顾技术特点与实际应用,反映当前LLM生态的多样性与演进方向。

开源 AI 视频生成模型又添新成员:SkyReels-V1

SkyReels-V1 是一款专注人物表现的开源AI视频生成模型,基于腾讯HunyuanVideo深度微调,在VBench多项指标上超越主流开源模型。支持33种表情与400+自然动作,具备电影级光影构图能力,推理框架提速58.3%,普通显卡即可流畅运行。

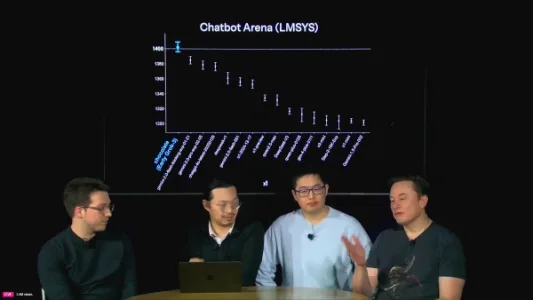

横空出世的 Grok 3 是否具有碾压性的优势?

Grok 3在数学、科学、编程等推理任务中全面超越Gemini 2、Claude 3.5 Sonnet与GPT-4o,Chatbot Arena盲测登顶1400分;搭载可追溯信源的Deep Search智能搜索工具,支持交叉验证与可控检索;已上线网页版及iOS应用,Grok 2即将开源,Grok 3后续亦计划开源。