#AI 模型

如何通过 PyTorch 手搓一个微型神经网络

用 PyTorch 从零手写一个拟合 y = x² 的微型神经网络,涵盖数据生成、训练/测试集划分、三层网络定义、MSE 损失与 Adam 优化器配置、迭代训练及预测可视化。全程代码简洁,适合初学者5分钟理解神经网络核心流程与训练逻辑。

AI生成的"工作垃圾"正在摧毁生产力

AI生成的“工作垃圾”看似专业,实则空洞低质,导致接收者平均每次耗时近2小时纠错返工。40%员工每月遭遇,已侵蚀协作信任、拉低对同事能力与可靠性的评价,并造成显著隐性生产力损失。

OpenAI 采用新的训练方法将 AI 智能欺骗行为减少 30 倍

OpenAI 与 Apollo Research 合作推出“深思熟虑对齐”训练法,要求模型行动前主动推理反欺骗规范,使 o3、o4-mini 等模型的隐秘行为减少约 30 倍(如从 13% 降至 0.4%)。该方法提升模型在新场景下的泛化对齐能力,但效果可能受其对评测环境的情境感知干扰。

OpenAI 正式发布了两款开放权重大型语言模型

OpenAI 五年来首次开放模型权重,发布 gpt-oss-120b 与 gpt-oss-20b 两款 MoE 架构大模型,支持代码生成、数学推理等任务;前者可在单卡 GPU 运行,后者适配笔记本;Apache 2.0 开源,已上线 Amazon Bedrock 与 SageMaker。

IBM 联合 O’Reilly 推出免费电子书《解锁 AI 价值创造》

IBM与O’Reilly联合发布免费电子书《解锁AI价值创造》,聚焦AI如何切实驱动增长与创新。书中整合跨行业真实案例、落地策略、伦理与运营挑战应对方案,以及AI融入企业战略和文化的实操建议,为企业提供可借鉴的AI价值实现路径。

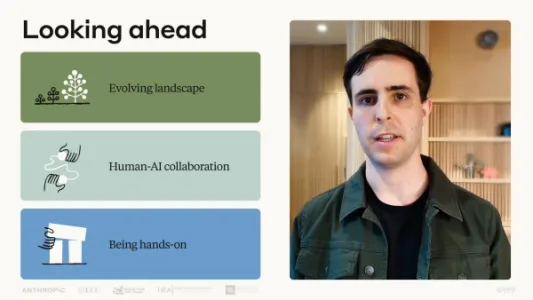

AI 流利性框架基础课程 第五课:生成式 AI 的能力与局限

生成式AI擅长文本生成、跨领域知识整合与专业概念解释,但受限于训练数据时效、易产生“幻觉”、上下文窗口有限、输出非确定性及复杂推理能力不足;其实际效能高度依赖可访问的数据源与工具。理解这些边界,是实现高效人机协同的前提。

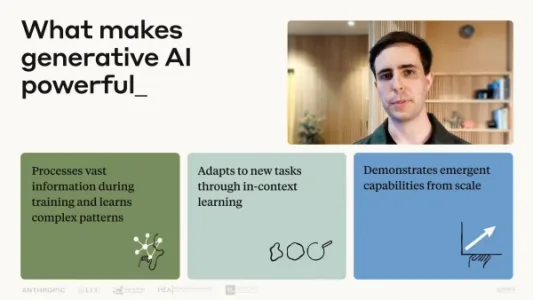

AI 流利性框架基础课程 第四课:深入解析生成式 AI

本课解析生成式AI核心原理:对比传统AI的“分析”属性,强调其“创造”能力;阐明大语言模型(LLM)如何依托Transformer架构、海量数据与强大算力实现突破;介绍预训练+强化微调两阶段训练机制,及其基于提示的上下文学习与涌现特性。

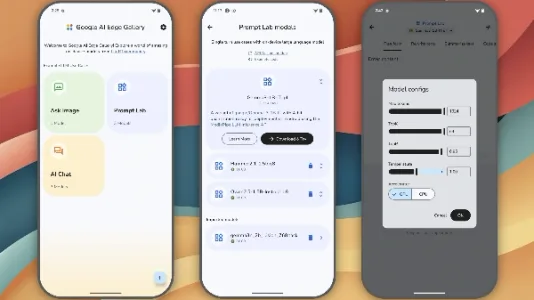

Google 推出 Android 本地模型运行神器:AI Edge Gallery

Google 推出实验性应用 AI Edge Gallery,支持在 Android 设备本地离线运行 Gemma 等生成式 AI 模型。无需联网即可实现图片问答、多轮对话、提示词实验,并可实时对比不同模型性能,还支持自定义 LiteRT 模型测试与 Hugging Face 一键集成。

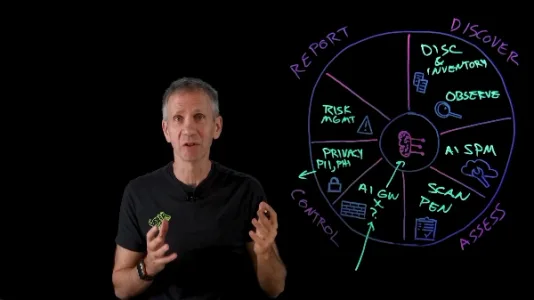

如何为 AI 系统打造安全 “护城河”

IBM提出“甜甜圈”AI安全体系,以“发现、评估、控制、报告”四环闭环,覆盖影子AI识别、动态风险评估、输入输出与权限管控,并通过可视化仪表盘和合规报告实现透明治理,强调安全需随AI演进持续迭代。