#智能体

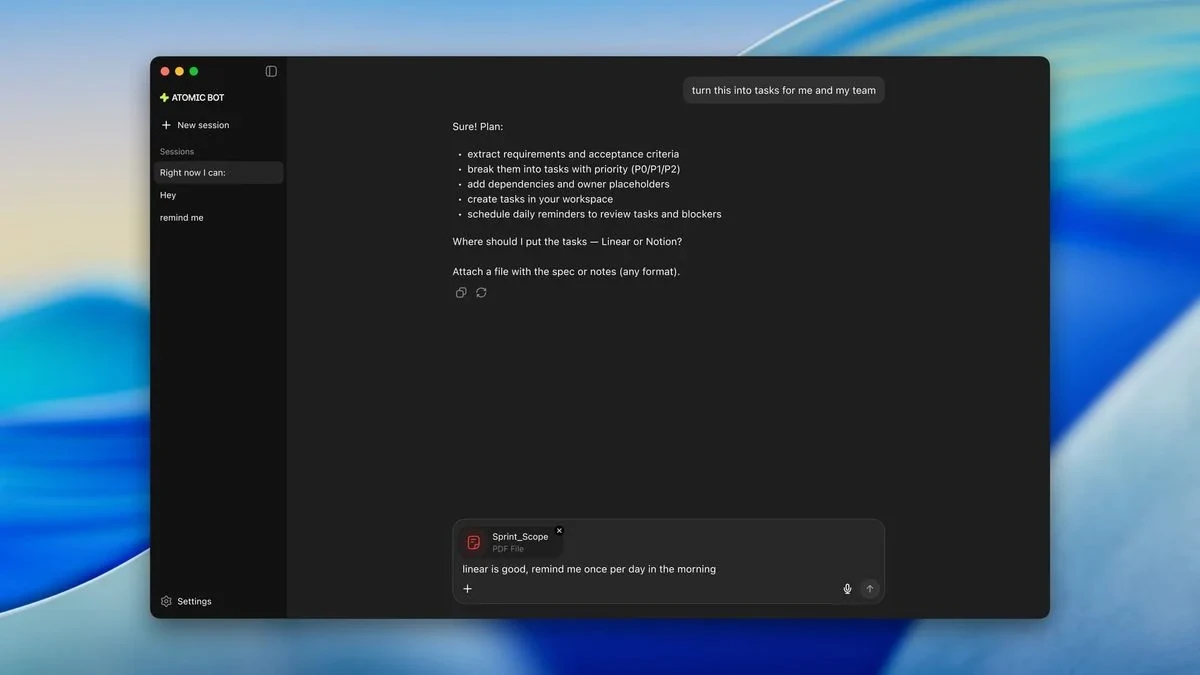

Atomic Bot 现可在电脑上运行本地 AI 模型

Atomic Bot 现已支持本地运行,通过 Ollama 集成 Llama 、 Gemma 、 Qwen 等开源模型,实现完全离线推理。其核心优势在于数据隐私保护和使用成本控制——用户数据不离开设备、无按条计费、无需注册账户。配置门槛相对亲民, 7B 模型仅需 16GB 内存即可运行,同时保留邮件、日历、浏览器自动化及跨平台消息等完整功能。基于 OpenClaw 框架开源构建,跨平台桌面应用简化部署。随着 AI 助手掌握高敏感个人信息,本地化运行将从开发者偏好演变为终端用户的刚性需求。

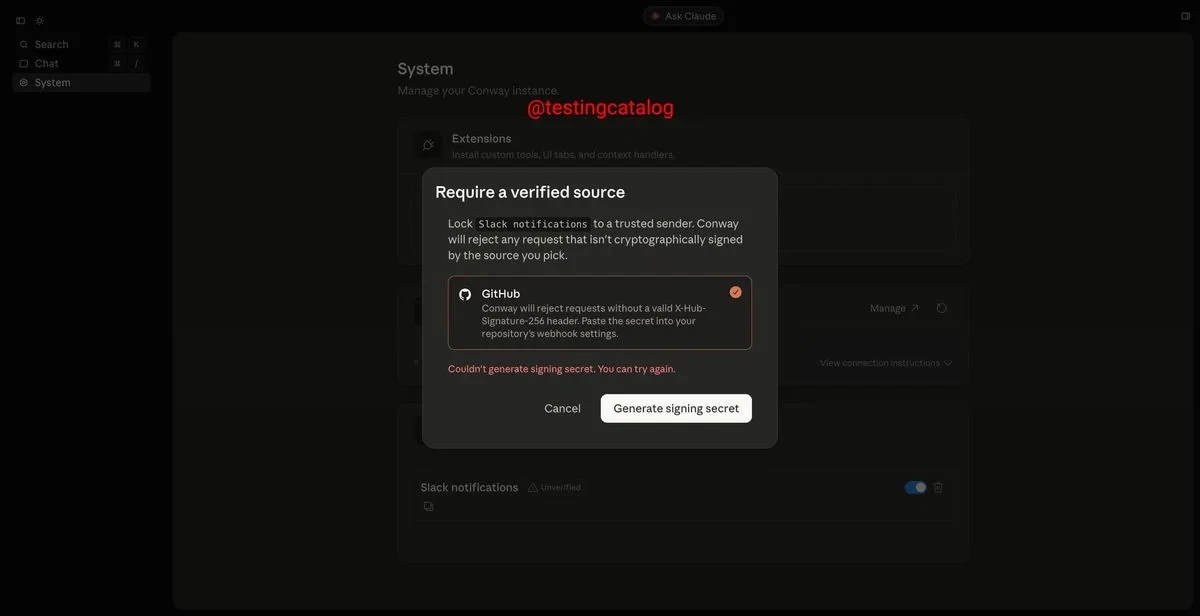

Anthropic 据传正在测试 24/7 全天候 AI 智能体服务

Anthropic 推出代号 Conway 的智能体项目,主打全天候托管服务,集成 Webhook 接口、加密签名验证、扩展组件和浏览器操作等企业级功能。该项目定位为连接 Claude Code 、 Cowork 等产品的“粘合剂”,构建持续运行的事件驱动智能工作空间。设计逻辑强调安全性、可审计性和系统自动化通信,目标用户已从个人开发者转向企业客户。这也折射出 AI 行业从个人生产力工具向团队托管式智能体基础设施的范式转移趋势。

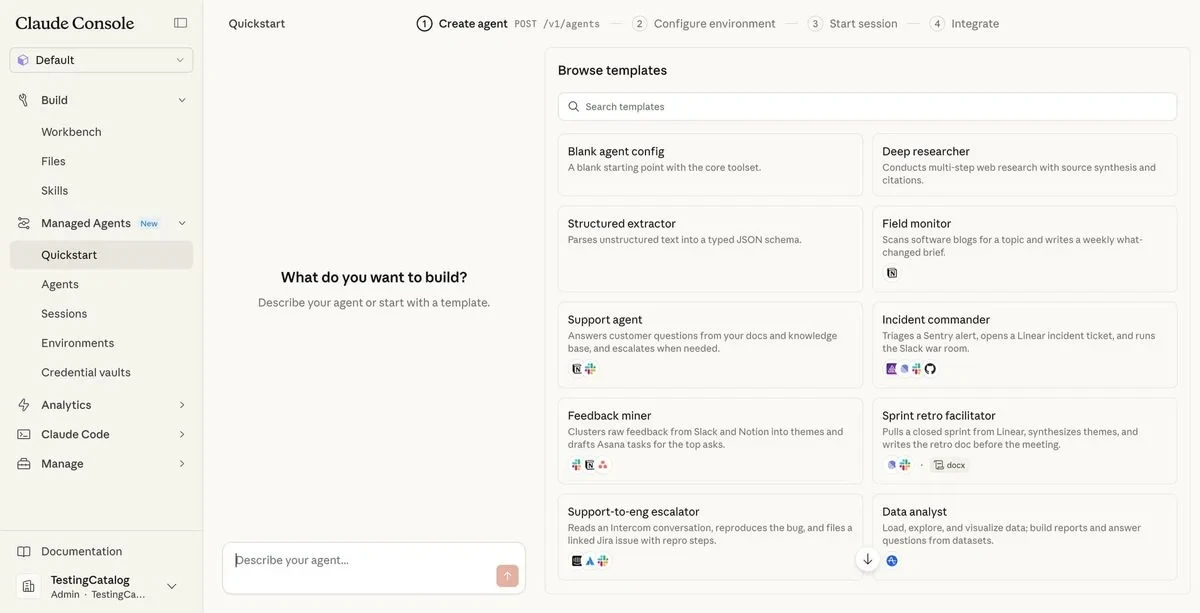

Anthropic 推出面向企业的 Claude 托管智能体

Anthropic 推出 Claude Managed Agents 企业级 AI 智能体开发平台,基于 Claude 模型提供安全沙箱、身份认证、持久会话等基础设施能力,开发者可专注任务设计而无需自建底层架构。内部测试显示文件生成成功率提升 10%, Notion 、 Sentry 等企业已接入,覆盖代码自动化、财务等工作流场景。 Anthropic 正从模型输出向平台化服务转型,旨在将智能体部署周期从数月缩短至数天。

这家创业公司推出付费服务:与 AI 版人类专家对话

Onix 公司推出“智能体订阅”服务,用户可订阅专家 AI 分身获取健康咨询。服务以隐私保护和专家参与训练为卖点,年费仅 100-300 美元,远低于线下咨询 600 美元/小时。但测试发现 AI 易被带偏话题,且产品推荐存在利益冲突。核心问题在于:当 AI 分身的使命与利益绑定时,所谓“中立建议”的成色将大打折扣。这或许比技术本身的不成熟更需要关注。

演员打造的开源AI记忆系统,基测分数是 Mem0 两倍

演员米拉·乔沃维奇与程序员 Ben Sigman 联手推出开源项目 MemPalace,旨在解决大模型上下文记忆缺失的痛点。该系统在本地构建 “记忆宫殿”,采用 AAAK 压缩技术将个人信息浓缩至约 120 Token,支持跨月语义搜索及矛盾检测。实测中其在多项基准测试取得满分或领先成绩,且无需 API 密钥或云服务,完全本地运行,为开发者提供了高效、私密的 AI 记忆解决方案。

一个记忆优先的多智能体平台:Letta

新推出的多智能体平台 Letta 主打“记忆优先”,通过后台记忆智能体将对话沉淀为可版本追踪的 Git 文件,支持回溯与回滚。其核心优势在于模型与记忆解耦,切换底层大模型不影响会话状态。目前支持 macOS、Windows 和 Linux 三端,适合希望构建长期记忆、实现跨平台协作的智能体用户。

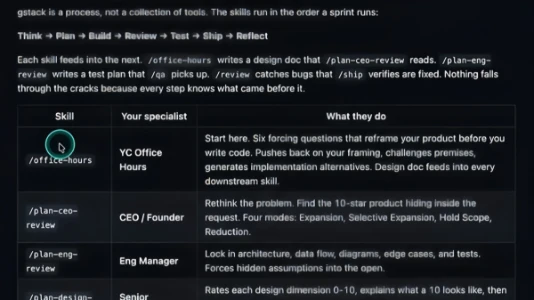

【AI教程】四个开源项目,让你的 AI 化身整个公司

拆成可复用角色;hermes-agent 主打任务后自动沉淀技能、让智能体越用越聪明;Superpowers 以测试驱动流程串起开发全链路;Paperclip 则尝试用多智能体编排“零人工公司”。

AI 真的会把你的工作抢走吗?或许这个问题本身就错了!

领导力专家Vinciane Beauchene指出,“AI会抢工作吗”是伪命题——真正关键在于人机分工重构:AI处理任务,人专注关系、信任与真实互动。她警示三大认知误区,并强调ACI(自主智能体)已迫近,企业需以战略为先,系统投入持续性人才成长。

【AI教程】5个超级实用的龙虾(OpenClaw)使用方式

Alex Finn 推出5种高实用性 OpenClaw(龙虾)用法:搭建每日日志实现长期记忆归档;接入社交平台API实时捕获热点并推送;手机语音触发“氛围编程”快速生成自用工具;多模型协作模拟“私人研发团队”输出决策备忘录;设置定时任务让AI通宵自主推进目标。