#Runway

让 AI 视频拥有电影质感的九层结构提示词

如何让 AI 视频拥有电影质感?提示词应采用导演语言而非被动描述,需包含主体、微动作、环境、摄像机、灯光、风格、情绪、物理细节、渲染质量九层结构。文章还总结了微动作工程、摄像机定义、布光逻辑、情绪编码及可控混乱等策略,并提供了多条完整示例。创作者需注意框架易致同质化,真正的竞争壁垒在于对细节分寸和不可模板化判断的把握。

Runway 学院,教你如何固定人物形象和声音

通过生成角色多角度参考图集并配合说话视频,可让 Seedance 2 等模型在后续创作中精准锁定人物外观与声音。该方法不仅适用于写实角色,用户只需上传个人照片及语音片段,即可快速构建数字分身,实现跨场景的个性化内容生成。

Runway CEO 称 AI 可将好莱坞 1 亿美元大片改为 50 部电影

Runway CEO Valenzuela 在 Semafor 论坛上提出激进主张:好莱坞应将单部电影 1 亿美元预算分散投入 50 部同等体量影片,通过规模化生产提升爆款命中率。他认为 AI 正全方位降低制作成本,传统依赖精英创作者和精准押注的模式将被“数量游戏”取代,并以《 Bitcoin : Killing Satoshi 》 7000 万 AI 制作成本对比传统 3 亿预算为实证。 Valenzuela 直言影视业创意危机源于经济激励失衡, Runway 愿景是让更多未被听见的声音借助技术登上舞台。

Runway 推出 Characters,让 AI 聊天机器人有形象、声音和个性

Runway 推出 Characters 功能,用户上传正面人像、选择声音、命名并设定个性(如徒步向导或语言老师),一分钟内即可生成具形象、声音与行为逻辑的 AI 角色,让对话更自然、更有代入感。

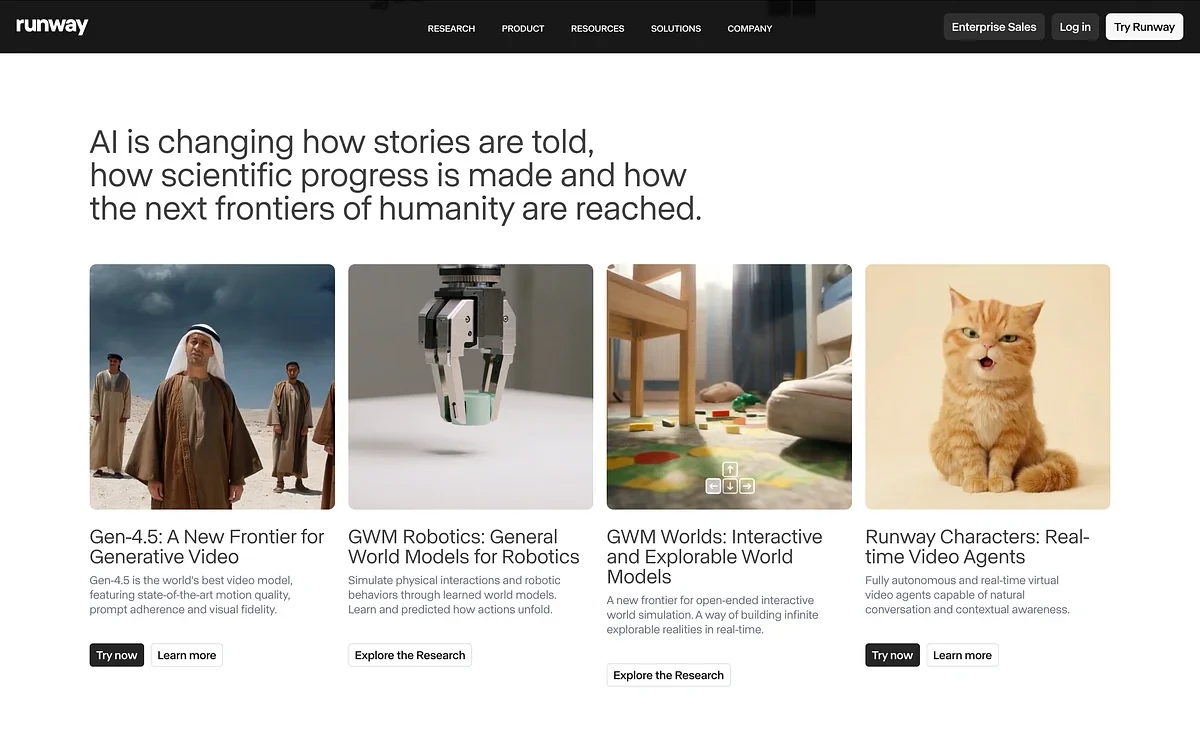

Runway 年终 5 大升级 向通用世界模型迈出一大步

Runway 年终发布五大升级,核心是 Gen-4.5 多模态视频模型(支持有声电影生成与音画协同编辑)和通用世界模型 GWM-1;后者涵盖虚拟空间构建(GWM Worlds)、高保真数字人(GWM Avatars)、机器人训练模拟(GWM Robotics),并联合英伟达等共建大规模训练平台。

AI 惊悚科幻短片《The Third Den》

Juan Felipe Orozco 用 Runway 工作流打造2分多钟AI惊悚科幻短片《The Third Den》(《撒诞》),画面连贯、表情动作自然、氛围压抑有力;为达成理想效果,耗时300小时生成2000多个片段。

Runway 转型一站式 AI 创作平台

Runway 正推进一站式 AI 创作平台战略:视频生成与编辑仍由自研 Gen-4 和 Aleph 模型支撑;图像生成引入 Google 的 Nano Banana;音频能力则整合 ElevenLabs。体现“核心自研+关键第三方”协同路径,聚焦创作者工作流整合。

Runway 推出工作流 让视频制作更加简单直观

Runway 推出工作流(Workflows)功能,融合大语言模型,让视频生成、编辑与合成更快速、更直观。这一更新标志着其重心从底层技术探索转向实际创作场景落地,AI视频工具正变得更易用、更贴近创作者日常需求。

如何构建 Runway 自定义工作流

Runway 自定义工作流支持模块化搭建,操作逻辑类似 ComfyUI;文本生成调用 Gemini 2.5 Flash,图像生成采用第三方 Nano Banana 模型,仅视频生成节点使用 Runway 自研的 Gen-4 模型。