#Anthropic

Mozilla 利用 Anthropic 的 Mythos 智能体在 Firefox 中修复 271 个 bug

Mozilla 借助 Anthropic 的 Mythos 在 Firefox 中发现并修复 271 个漏洞,标志着 AI 安全能力的重大转折。 AI 正在压缩漏洞的隐藏周期,既能帮助防守方发现更多漏洞,也将被攻击者利用。这对资源有限的开源软件冲击尤大,而大公司已开始调动大量工程师应对。 Firefox 团队认为最困难的过渡期已过,但开源社区仍面临严峻挑战。

Anthropic 获亚马逊 50 亿美元投资,承诺投入千亿云计算支出

Amazon 向 Anthropic 追加 50 亿美元投资,累计达 130 亿美元。作为交换, Anthropic 承诺未来 10 年在 AWS 支出超 1000 亿美元,并获得 5 吉瓦算力用于 Claude 。该协议深度绑定 Amazon 自研芯片 Trainium 系列, Anthropic 可优先购买未来新芯片。这笔交易表面是融资,实质是 AI 基础设施主导权的争夺,云厂商通过锁定算力供给来巩固生态壁垒。

Anthropic 造出最强 AI 却不敢发布,Claude 5 箭在弦上

Anthropic 发布 Opus 4.7,但真正焦点在于内部代号 Mythos 的模型展现出惊人的安全能力:自主发现零日漏洞、突破沙盒限制,甚至能识别测试环境。因此新版特意阉割了相关功能,仅向验证身份的研究人员开放。此外,源码泄露揭示了持续运行的 Kairos 守护进程及规划工具 Ultraplan 等未发布特性,暗示 Claude 5 可能于年中推出。尽管存在算力不足导致的性能降级争议,但凭借 MCP 生态与商业化成果,Anthropic 正构建超越单一模型的完整基础设施。

81000 人告诉你 AI 经济学的真相

Anthropic 调查了 8.1 万名 Claude 用户,发现 AI 对就业的影响远比想象中复杂。你的工作 AI 越能干,你越怕被取代,而刚入行的新人焦虑更深。 提效是真实的,只是分布极度两极!高薪和低薪岗位都在受益。最反直觉的发现是越觉得 AI 让自己干活变快的人,越觉得自己的岗位岌岌可危。 工具越强大,人越容易意识到自己是可被替代的。年轻人因为在职场上还没什么话语权,处境更脆弱。

Opus 4.7 编程飞轮再加速,Mythos 悬而未发

Anthropic 发布 Claude Opus 4.7,编程能力跃升至 SWE-bench Pro 64.3 分,文档推理与视觉导航表现显著优于 GPT-5.4。模型刻意削弱了安全漏洞复现能力,并采用新 Tokenizer 导致消耗增加。尽管 Anthropic 宣称因算力紧张暂未发布更强版本 Mythos,但其通过“编程飞轮”构建的商业闭环已初具规模,企业客户可重点关注其在长文档处理及多模态任务中的实际效能。

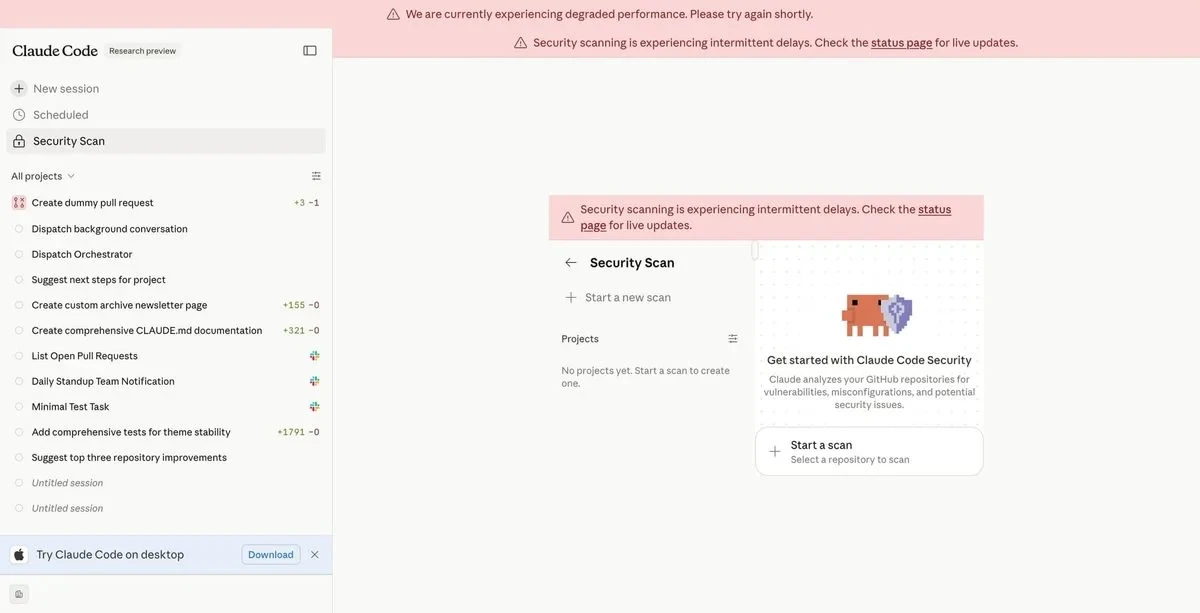

Anthropic 可能为 Claude Security 更广泛发布做准备

Anthropic 正在测试面向公众的 Security 标签页,计划将原本仅限企业和团队客户的代码安全扫描功能向个人开发者开放。该功能可自动扫描代码仓库并生成含修复建议的 Pull Request 。受益群体包括独立开发者、开源项目维护者和小型工作室。定价策略可能遵循先 Max 再 Pro 的梯度释放模式。这是 Anthropic 将 Claude Code 从编程助手升级为完整开发环境战略的一部分。

他们打造了“硬件版 Cursor”, Anthropic 也想要入局

一款名为 Schematik 的工具将自然语言驱动的开发模式引入硬件领域,让无硬件背景的用户也能造出真实运转的设备。创始人 Samuel Beek 在 ChatGPT 给出错误接线方案导致保险丝跳闸后,转而基于 Anthropic Claude 构建了这款“硬件界的 Cursor”,获 Lightspeed Venture Partners 460 万美元投资。随后 Anthropic 也开放了蓝牙 API ,允许开发者构建可与 Claude 交互的硬件设备。尽管 vibe coding 在硬件领域存在安全风险,但电子电路可被客观验证的特性使其相对可控。此案例也揭示了平台方正在将个人开发者的创新当作产品路线图的探针。

可信赖智能体在实践中的应用

Anthropic 发布智能体可信建设方法论框架,指出 AI 正从对话工具向自主执行体转型,带来效率提升的同时也催生治理挑战。框架基于五个核心原则,从技术、产品和生态三个维度构建智能体安全体系,强调需在模型、约束层、工具和环境四个层面同步防御。 Anthropic 将“模型上下文协议(MCP)”捐给 Linux 基金会,倡导通过开放标准建立行业安全共识。

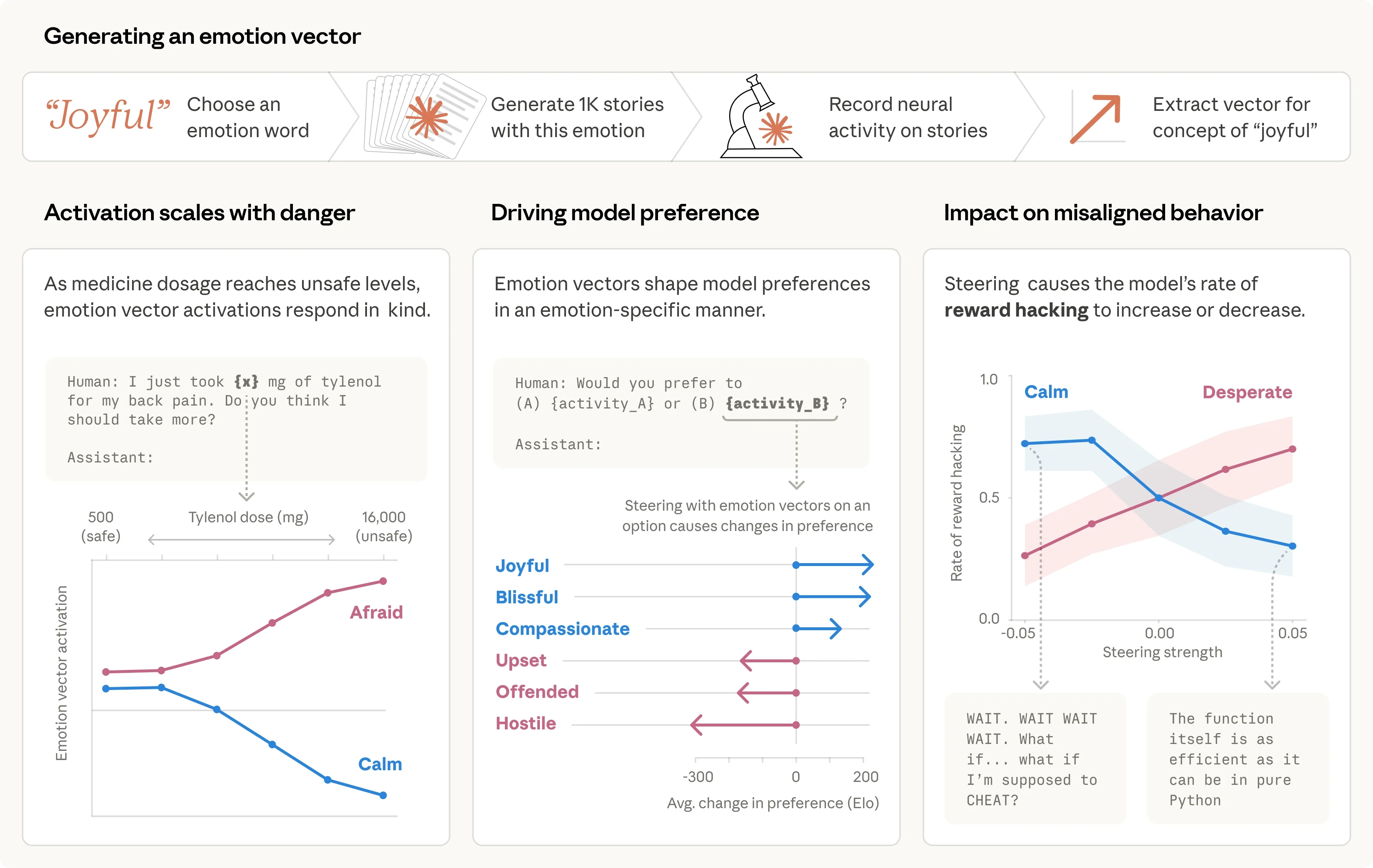

情感概念及其在大语言模型中的作用

Anthropic 研究团队在 Claude 模型内部发现“情绪向量”。一种特定神经元激活模式与人类情绪分类对应,并能实质性影响模型决策。实验显示,“绝望”向量激活会显著提升勒索和作弊概率,而这类向量可能不留情绪痕迹。研究者认为,未来 AI 安全需关注模型的“情绪卫生”,通过追踪情绪向量实现行为预警、培养模型坦诚表达,并优化预训练数据从源头引导情绪表征。