提示词工程已死,上下文工程崛起:Karpathy 最新演讲透露的信号

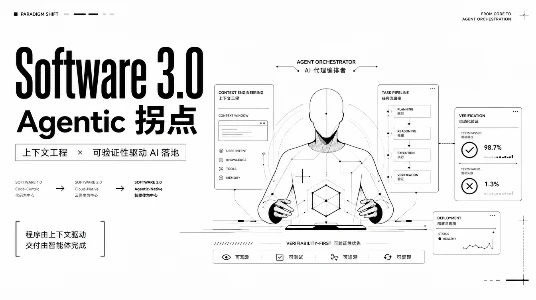

4 月 30 日,Karpathy 在 Sequoia Ascent 2026 提出 Software 3.0 概念,指出 2025 年 12 月已成为 Agentic 拐点。核心变化在于工作流从编写代码转向编排 Agent,上下文窗口成为新程序杠杆。他强调 AI 落地速度取决于场景是否具备自动化验证信号,而非单纯模型能力。开发者应关注任务的可验证性与训练数据分布,普通用户则需尝试将完整宏观任务交付给 Agent。

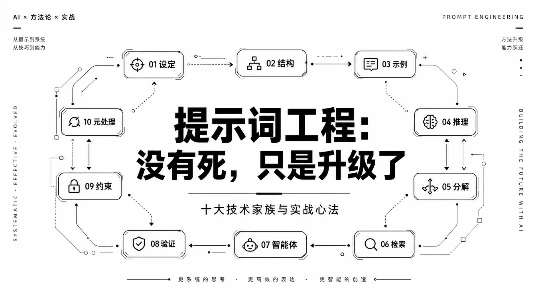

2026 年提示词工程的十大技术家族与实战心法

提示词技术清单已近百种,死记硬背不如掌握“何时用”。文章将技巧归纳为十大家族:设定、结构、示例决定输入,推理、分解引导思考,检索、智能体连接外部世界,验证、约束、元处理保障可靠性。生产级提示词通常组合多个家族,先诊断问题所属家族再选具体手法,比盲目尝试更高效。

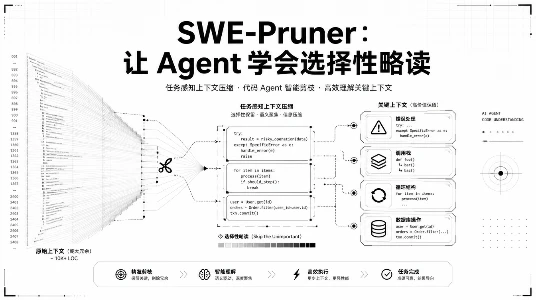

代码 Agent 的上下文减肥药:SWE-Pruner 是怎么让模型少看多想的

针对代码 Agent 上下文昂贵且易迷失的痛点,SWE-Pruner 提出模仿人类“选择性略读”的策略。该方案通过任务目标引导剪枝,利用 0.6B 小模型动态筛选关键代码片段,而非依赖破坏语法的固定指标。实测显示,其在 SWE-Bench 等任务中 Token 消耗降低 23% 至 54%,成功率反而提升。这一思路为长代码处理提供了新方向,尤其适合需要本地部署或边缘计算的 Agent 落地场景。

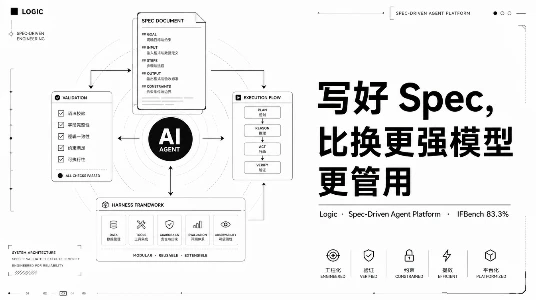

写规格说明,不写代码:Logic 如何用 500 字 spec 把模型指令遵循率拉高 6 个点

西雅图创业公司 Logic 上线 spec 驱动 Agent 平台,用自然语言规格说明替代复杂工程。实测显示,在 IFBench 基准测试中,仅凭 500 字规范配合其自动化 harness,Gemini 3.1 Pro 性能提升 6 个百分点并登顶榜单。该平台将输入验证、契约执行等基础设施产品化,支持主流模型路由。对于正在开发 Agent 的团队,这证明优化约束描述比盲目升级模型更有效,目前已有超 250 家机构使用。

上下文工程到底在解决什么问题

2026 年 AI 应用开发重心正从提示词工程转向上下文架构。随着 Claude Opus 4.7 等模型长时任务可靠性提升,Agent 失败主因转为上下文窗口管理不当引发的“上下文腐烂”。Logic.inc 指出需系统管控七层上下文信息,Anthropic 亦推出工具调用新特性优化连接层。对开发者而言,核心壁垒已变为如何设计信息架构,确保 Agent 在复杂场景中稳定运行。

从“调工具”到“搞架构”:为什么 2026 年 Prompt 工程师开始恶补系统设计?

AI 应用从 Demo 到上线常因架构缺陷而失败,单纯优化 Prompt 已无法解决多步推理与复杂协调问题。文章提出了 Goal-Oriented Agents 的迭代循环机制,并详解生产级四层架构:规划层分离意图与行动,委托层通过子 Agent 隔离上下文,持久化层外接记忆突破窗口限制,综合层统一输出结果。该方案将开发重心从提示词工程转向系统设计,是构建可扩展、高可靠 AI 系统的核心方向。

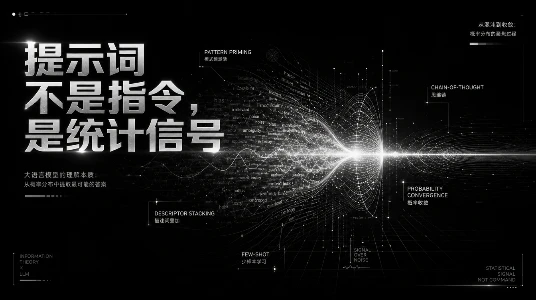

提示词不是指令,是统计信号

AightBits 提出 Pattern Priming 技巧,核心在于将提示词视为统计信号而非指令。通过密集堆叠“客观”“事实”等近义修饰词(Descriptor Stacking),利用词汇在训练数据中的分布特性,精准引导模型输出风格。该方法与 Few-Shot、思维链机制不同,适用于需要严谨学术语气或避免推测的场景。针对长对话中的行为漂移,建议开启新会话并压缩关键信息,而非单纯增加指令。

OpenAI 学院:提示工程基础

提示词工程是设计和优化 AI 输入指令的核心技能,关键在于明确任务目标、提供背景信息并描述期望输出形式。随着指令精细化程度提升, AI 回答质量显著改善。面对复杂问题时采用分步提问、在具体性与简洁性间寻求平衡可获得更精准的回复。本质上这是一种精准表达的修炼,体现了与 AI 协作的迭代优化过程。

【AI工具】Luma 推出统一智能模型 Uni-1

Luma 推出统一智能模型 Uni-1,首次实现单模型跨模态理解与生成,支持文本、代码、长视频、语音、音频,并在一次前向传播中同步完成语言推理与视觉生成,具备计算、逻辑推演与审美判断能力,推动AI从“提示词驱动”迈向“意图理解型”创作伙伴。