多智能体连续工作 16 天,验证契约和串行执行是关键

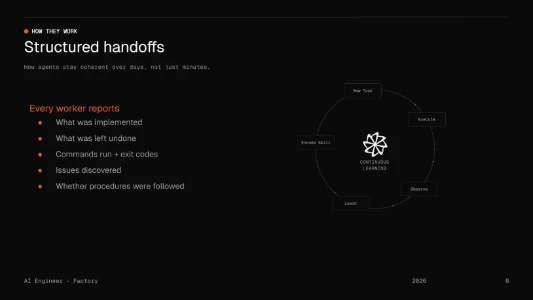

Factory 工程师 Luke 分享多智能体系统 Missions 架构,核心在于解决人的注意力瓶颈。该系统采用编排、工作、验证三角色分工,强调“先定义完成标准”再写代码,通过串行执行降低协调开销,并强制结构化交接以支撑长周期任务。不同角色匹配专用模型,编排逻辑主要依赖提示词,使团队能同时处理的工作流数量从 10 条提升至 30 条。

Prompt Evolution :迭代提示词设计让多智能体性能提升 30%

在多智能体系统中,提示词质量而非模型能力才是决定表现的关键。通过对主智能体、分析智能体、编码智能体和评判智能体提示词的系统性演进,工作流效率能够提升 30%。核心方法包括:明确智能体角色边界,将约束显式编码,将编码智能体从“作者”降格为“编译器”,以及依据失败模式驱动迭代。这一实践揭示了工业级 AI 工作流的本质。越确定性的任务越需要确定性的约束,而非期待模型自行领会意图。

高级提示词实用指南:打造精准高质量 AI 图像

文章指出 AI 图像生成效果不佳的根本原因在于提示词质量,而非工具本身。核心观点是使用结构化描述替代模糊指令,将“主体+环境+风格+光线+细节”五个维度纳入提示词。描述越具体, AI 生成方向越明确,随机性越低。常见问题包括概念混搭、关键词堆砌、忽视光线设定等。实用技巧是把提示词当作向朋友描述画面,保持语义连贯。提示词质量直接影响点击率,这种结构化思维与写产品需求文档、设计简报的逻辑相同。

LLM 工作原理: Prompt Engineering 解析

大语言模型本质是概率引擎,通过 Token 切分和数字编码逐步预测下一个内容。由于概率采样的非确定性特性,输出存在自然波动,这是设计而非缺陷。温度参数控制输出创意度,最大 Token 数限制回复长度, Top-P 核采样限定选词范围,上下文窗口决定记忆容量。实操建议:温度和 Top-P 只调其一,配合最大 Token 数系统性配置,可有效提升提示词工程的可控性。

10 条能帮创业者看清方向、赚到钱的 AI 提示词

创业者常将 AI 误用为“打字机”,导致模糊问题换来模糊答案,收效甚微。核心问题不在工具本身,而在提问质量!只有具体的问题才能换来具体的决策方向和盈利路径。文章提供 10 个专门设计的提示词,强调使用前需做好“上下文投喂”这一前置动作。

上下文工程实战:让 AI Agent 在超长对话中不失忆的三大策略

GPT-5.5 等模型虽推理强劲,却常因“上下文衰退”在长任务中遗忘关键信息。文章剖析滑窗截断、分层摘要及记忆卸载三大策略,指出单纯扩大窗口无效,需构建外部记忆架构。通过热温冷三层结构与增量更新机制,可显著提升多步骤工程任务的稳定性与 Token 利用率,为开发长程 AI Agent 提供核心设计思路。

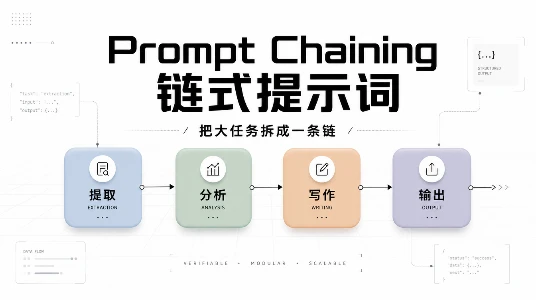

一条提示词干不完的活:Prompt Chaining 实战指南

面对复杂任务,单条提示词常因上下文溢出、错误累积和职责混杂导致失败。Prompt Chaining 通过将大任务拆解为提取、分析、写作等独立步骤,显著提升输出质量与可控性。文章详解顺序链、条件路由链及并行链三种核心模式,提供从用户反馈分析到客服系统的实操模板,并指出信息衰减、格式不兼容等避坑要点。无论是个人开发者还是企业团队,掌握链式调用都能以更低返工成本实现高精度自动化处理。

“扮演专家”已经是中阶操作了:2026 年提示词应该怎么写?

2026 年提示词进阶不再依赖“扮演专家”这种易导致答案平庸的单人角色。Reddit 社区推崇“专家辩论面板”,通过模拟多方观点冲突强制模型暴露技术权衡,有效解决自我纠错缺失问题;同时引入“压缩协议”,将核心约束高密度呈现以对抗长文本遗忘。配合 ReAct 循环与上下文工程,这些方法从结构上重塑模型行为,适合追求深度推理与复杂决策的开发者,标志着提示词正从个人技巧转向系统化基础设施。

精通 Claude 提示工程:营销人员实操指南

模糊指令是 AI 输出质量低下的根源,强调结构化提示词工程已成为营销竞争优势。核心方法包括:任务定义要具体、明确角色设定、指定输出格式。技术层面可通过让 AI 先推理、加约束条件、一次生成多版本等方式提升效果。元提示词可实现工作流复用,持续测试迭代是保持输出稳定的关键。