Mistral把 编程 Agent 扔进云里:Vibe 远程代理 + Medium 3.5,开源 128B 模型干翻 Claude Sonnet 4

4月29日,Mistral做了一件很多公司想做但没做好的事:把 AI 编程 Agent 从“人盯屏幕”模式推进到“甩给云端等 PR”模式。

这不是又一个小版本更新,是三个东西一起砸下来!Medium 3.5 模型、Vibe 远程代理、Le Chat 工作模式。它们之间的关系不是“顺便发布”,而是一条完整的产品逻辑链。模型提供能力底座,远程代理改变执行方式,工作模式把同样的能力延伸到非编程场景。

看完所有官方文档和社区讨论后觉得,这件事对普通开发者和团队的影响,比 Benchmark 数字告诉你的要大得多。

Medium 3.5:128B 稠密模型,开源权重,77.6% SWE-Bench

先说模型。Medium 3.5 是 Mistral 最新旗舰,128B 参数的稠密 transformer,256K上下文窗口。注意“稠密”这个词,它不是混合专家架构,每次推理时128B 参数全部参与计算。这意味着延迟更可预测,在长时间 agent 会话中行为更稳定。

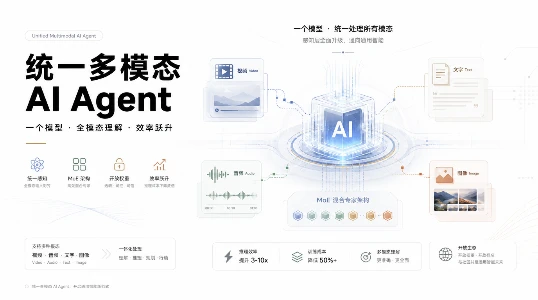

这个模型把 Mistral 之前三个产品线合并了:Medium 3.1(指令遵循)、Magistral(推理任务)、Devstral 2(编程代理)。一个端点搞定所有场景,不用再根据任务类型切换模型。

最关键的数字:SWE-Bench Verified 77.6%。这是开源权重模型的最高分,超过了 Claude Sonnet 4 的 77.2%。排在前面的只剩 GPT-5.5(82.6%)、Claude Opus 4.7(82.0%)和Gemini 3.1 Pro Preview(78.8%),全是闭源模型。

价格也很有竞争力:输入每百万 Token约10.8元人民币,输出每百万 Token约 54 元。自部署最低需要 4 张GPU、约 128GB 显存(FP8量化)。

两个容易被忽视的亮点

第一,推理深度可配置。API 调用时可以设置 reasoning_effort 参数,同一个模型既回答快速查询,也执行复杂的多步推理。写文档注释用低推理深度,重构整个模块拉满推理深度。这对 API 用户来说是真金白银的节省。

第二,视觉编码器从头训练。大多数视觉语言模型复用 CLIP 等预训练编码器,Medium 3.5 自己训练了一个支持可变分辨率和宽高比的编码器。手机截图、系统架构图、横屏照片都能直接处理,不用裁剪缩放丢信息。

Vibe远程代理:不再盯着屏幕等 AI 写代码

这才是今天真正要说的重点。

之前的 Vibe 是本地CLI工具,Agent在你的终端里跑,你守着看它一步步操作。这种方式和所有其他编程助手一样:人类是瓶颈,Agent 每走一步等你确认。

远程代理彻底改变了这个模式。你现在可以:

从 CLI 或 Le Chat 启动一个云端会话,描述任务,然后关上笔记本。Agent在隔离沙箱里独立运行,读写文件、安装依赖、跑测试、迭代修复。完成后自动在 GitHub 上开 Pull Request,通过 Slack 或 Teams 通知你。

多个会话可以并行运行互不干扰。你同时丢5个任务出去,它们各自在各自的沙箱里干活,最后回来 5 个 PR 让你审。

还有一个实用功能叫“会话传送”:本地正在跑的会话,可以一键迁移到云端继续运行,任务状态、文件差异、审批历史全部保留。你在咖啡馆开始一个任务,发现要跑很久,按一下就甩到云上,合上电脑走人。

Mistral 官方对远程代理的设计定位非常精准:它不是帮你做架构决策的,它是帮你处理“量大面广、定义清晰、产出可审”的活。模块重构、测试生成、依赖升级、CI 故障排查、范围明确的bug修复。这些东西占开发者大量时间但不占判断力。

Le Chat 工作模式:从编程助手到通用代理

Mistral 同时发布了 Le Chat 的工作模式(Work mode)。这是 Vibe 远程代理能力的泛化版本:不限于编程,可以跨邮件、日历、文档、Jira、Slack同时操作。

工作模式的核心设计原则是“连接器默认开启”而非手动选择。Agent可以主动访问你的邮箱、日历、文档系统来获取上下文,不需要你每次手动授权。但在执行敏感操作(发消息、写文档、修改数据)之前,会要求你显式批准。

每个操作步骤都可见:工具调用、推理过程、审批记录全部透明。这是 Mistral 在 agent 透明性上做的一个正确选择,尤其是在企业场景下,审计追踪是刚需。

这对我们意味着什么

编程助手市场从“交互式”转向“异步式”

Cursor、Windsurf、Claude Code目前的主流模式都是人在循环中,Agent 写一步你审一步。Vibe远程代理代表的是另一种哲学:你定义边界和约束,Agent独立完成,你审查最终产出。

这就像从结对编程变成代码审查。不是说哪种绝对更好,而是有些任务天然适合异步:依赖补丁、测试覆盖、CI修复、范围明确的重构。把这些活扔给云端Agent并行跑,你只审PR,效率提升不是线性的而是倍数级的。

开源权重改变了游戏规则

Medium 3.5 是开源权重(Modified MIT许可证),77.6% 的SWE-Bench 分数超过了 Claude Sonnet 4。这意味着有安全合规要求的团队可以在自己的基础设施上部署一个接近前沿水平的编码模型,不用把代码发给第三方。

沙箱隔离是企业采用的钥匙

每个远程会话跑在独立沙箱里,不共享文件系统或依赖。这对企业来说是安全底线。Mistral 在公告里反复强调“隔离沙箱”而非“共享容器”,说明他们清楚企业在意什么。

你需要新的工作流设计

并行异步代理不是即插即用的。团队需要:

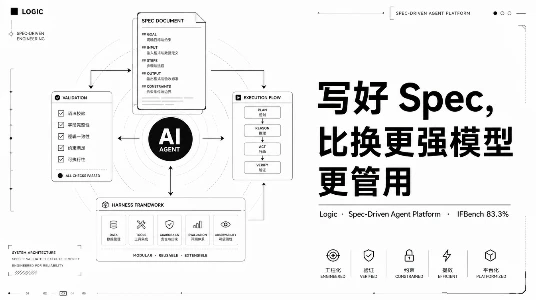

- 任务准入标准,不是所有任务都适合扔给Agent。定义清晰、测试可验证的活优先。

- 审查标准,每个被拒绝的 PR 应该记录原因代码:缺少回归测试、迁移路径不安全、样式不匹配等。这些标签反过来改善 Agent 的指令模板。

- 审批权限边界,哪些操作Agent可以自主执行,哪些必须人工批准,需要在制度层面提前定义。

价格对独立开发者和中小团队友好

输入每百万 Token 约 10.8 元、输出约 54 元的价格,加上开源权重可自部署的选项,让 Medium 3.5 成为目前性价比最高的高能力编码模型之一。自部署 4张 GPU 就能跑,这在云 GPU 租赁成本持续下降的趋势下越来越可行。

还缺什么

Vibe 远程代理目前只支持 GitHub 的 PR 流程,不支持 GitLab、Bitbucket。Le Chat 工作模式的连接器列表还比较短,主要覆盖 Atlassian 系和主流通讯工具。中文生态的飞书、钉钉、企业微信暂时没有集成计划。

另外,Mistral 的沙箱隔离目前是自建的,不是基于 Firecracker 或 gVisor 等成熟沙箱技术。对于安全要求极高的金融和医疗场景,这一点可能需要额外评估。

最后,Medium 3.5 虽然 SWE-Bench 分数很高,但在实际长链路 Agent 任务中的表现还需要更多实战验证。Benchmark 分数和真实任务完成率之间的差距,在所有模型上都存在,Mistral也不会是例外。

我的判断

Mistral这一波操作的核心并非“又出了一个新模型”,它把编程Agent的执行模型从同步改成了异步。这个变化看起来小,实际上改变了人和 AI 之间的协作节奏。

以前你用 AI 写代码,就像带实习生:他每写一行都要你看。现在变成了委派任务:你把活交代清楚,他去独立干,干完了你来审。

对于每天花大量时间在重复性编码任务上的开发者,这个转变意味着你可以同时推进多个原本会互相阻塞的工作流。瓶颈从“打字速度”转移到了“审查质量”。

开源权重、可配置推理深度、会话传送、沙箱隔离。这些设计细节放在一起,构成的是一个对开发者体验认真思考过的产品,而不只是一个模型排行榜上的名次。

如果你正在评估 AI 编程工具,建议认真看一眼 Vibe 远程代理的工作流设计。即使你最终选择其他工具,这种异步委派+审查门控的模式很可能会成为行业标准。