开源模型什么时候能真正跑赢那些动辄千亿参数的大怪兽?Google 最新发布的 Gemma 4 或许给出了一个有说服力的答案。

Gemma 4 模型家族有 4 个版本,最受关注的是 31B 稠密模型和 26B 的混合专家版模型(激活参数只有 4B)。在 Arena AI 文本排行榜上,31B 拿到了全球开源模型第三名,而它的对手 Qwen 3.5 总参数高达 3970 亿,Kimi K2.5 更是万亿级别。这样规模的模型,顶配 GB300 一样跑不动。而 Gemma 4 31B 在大多数中高端消费级 PC 上就能跑。

Gemma 4 的工具调用能力非常出色。SteveVibe 用 ToolCall 15 基准测试跑了所有 4 个版本的模型,31B 拿了满分。模型原生支持函数调用、结构化 JSON 输出、系统指令,能够无缝接入智能体工作流。AIME 2026 数学测试达到 89%,GPQA Diamond 84.3%,这样的的体量能有这样的成绩,确实也没什么好挑剔的。

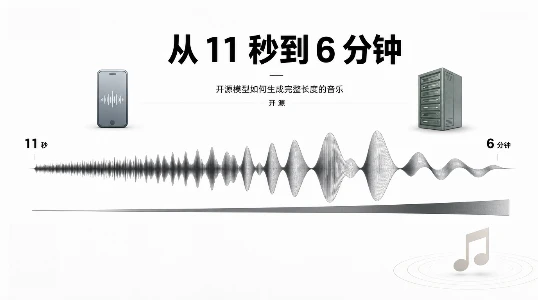

Gemma 4 的两个小尺寸版本 E2B 和 E4B 用了逐层嵌入技术(PLE),每个解码层有独立的小型嵌入表,实际推理时参数量远小于名义值。模型还专门为手机、树莓派这类边缘设备做了优化,并且原生支持音频输入。

让人稍感遗憾的是上下文窗口,最大只有 256K,和目前 1M 上下文的顶级模型相比还是有不少差距。

模型基于 Apache 2.0 协议,Hugging Face、Ollama、LM Studio 都能直接下,商用也没有问题。总的来说,Google 这款开源模型,性能算不上最好,但实用性和性价比都没话说。