人工智能(AI)正以前所未有的速度进化,而 Anthropic 推出的最新 AI 模型 Claude 3.7 Sonnet,则带来了突破性的“扩展思维模式”(Extended Thinking Mode)。这一创新让 Claude 能够像人类一样,在面对复杂问题时投入更多的思考时间,并提供更精确、更深入的答案。

扩展思维模式:让 AI 变得更“深思熟虑”

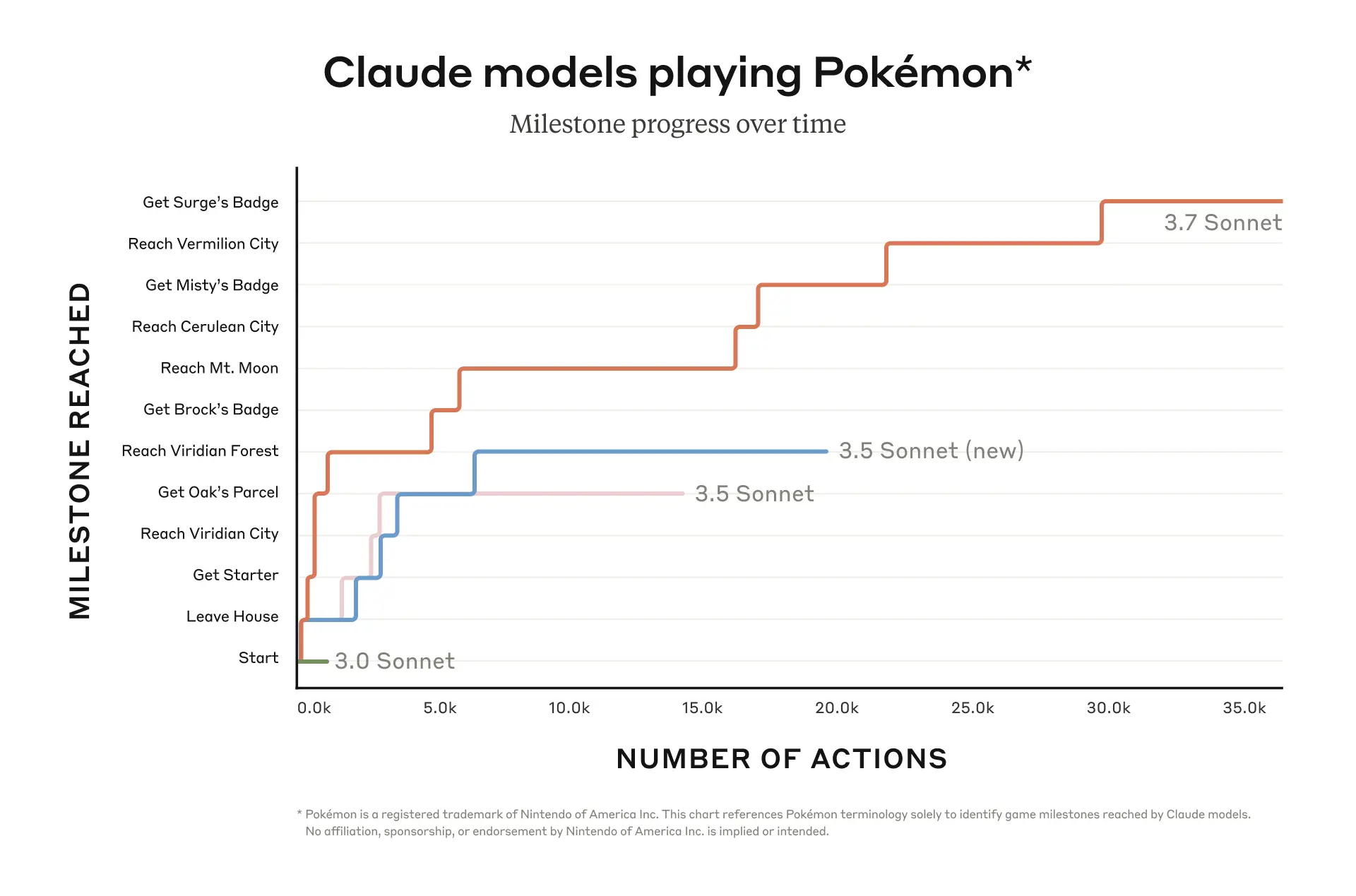

通常情况下,AI 在回答问题时会迅速生成答案,但面对复杂问题时,快速的响应方式可能导致思考不够深入,甚至出现错误。Claude 3.7 Sonnet 通过新增的 “扩展思维模式”,让用户可以手动开启 “深度思考” 模式,并且能够为 AI 设定 “思维预算”(Thinking Budget),精准控制它在某个问题上投入的算力和推理时间。

扩展思维模式并非是切换到另一个 AI 模型,而是让同一个 Claude 通过增加计算资源和思考步骤,来提供更高质量的回答。这种能力的提升,让 Claude 在逻辑推理、数学计算、代码调试等高难度任务上表现更优异。

透明的思维过程:让 AI 的“思考”可视化

以往 AI 的决策往往像 “黑箱” 一样,用户只能看到最终的答案,无法了解 AI 是如何得出结论的。Claude 3.7 Sonnet 通过 “可见思维过程”(Visible Thought Process)功能,让用户可以直接看到 AI 在思考问题时的内部推理过程。这一功能带来了三大优势:

- 提升信任度:用户可以观察 Claude 的推理逻辑,从而更容易检查和理解 AI 的答案。

- 改进 AI 对齐性:研究人员可以通过分析 AI 在内部思考和外部回答之间的差异,识别 AI 在某些情况下是否可能出现错误或误导性回答。

- 增强趣味性:许多数学和物理学家都表示,Claude 的推理方式与人类在解决复杂问题时的思维方式惊人地相似,甚至会反复检查自己的答案。

不过,这种可见的思维过程也存在一定挑战。例如,Claude 的思维过程可能缺乏人类语言的自然表达风格,部分推理可能是错误的,甚至在某些情况下,AI 可能会调整思维方式以适应 “被观察” 的环境,这些都是 Anthropic 未来需要深入研究的问题。

Claude 变身 AI 智能体:从回答问题到自主执行任务

Claude 3.7 Sonnet 不仅仅是一个聊天 AI,它还具备了更强的“智能体能力”(Agentic Capabilities),能够像一个虚拟助手一样执行复杂任务。例如,它可以模拟鼠标点击和键盘输入,在虚拟环境中操作计算机,甚至能够完成一系列开放式任务。

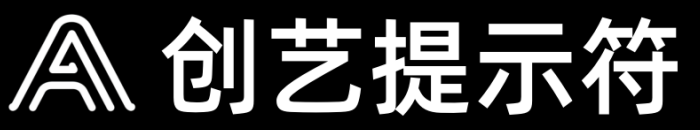

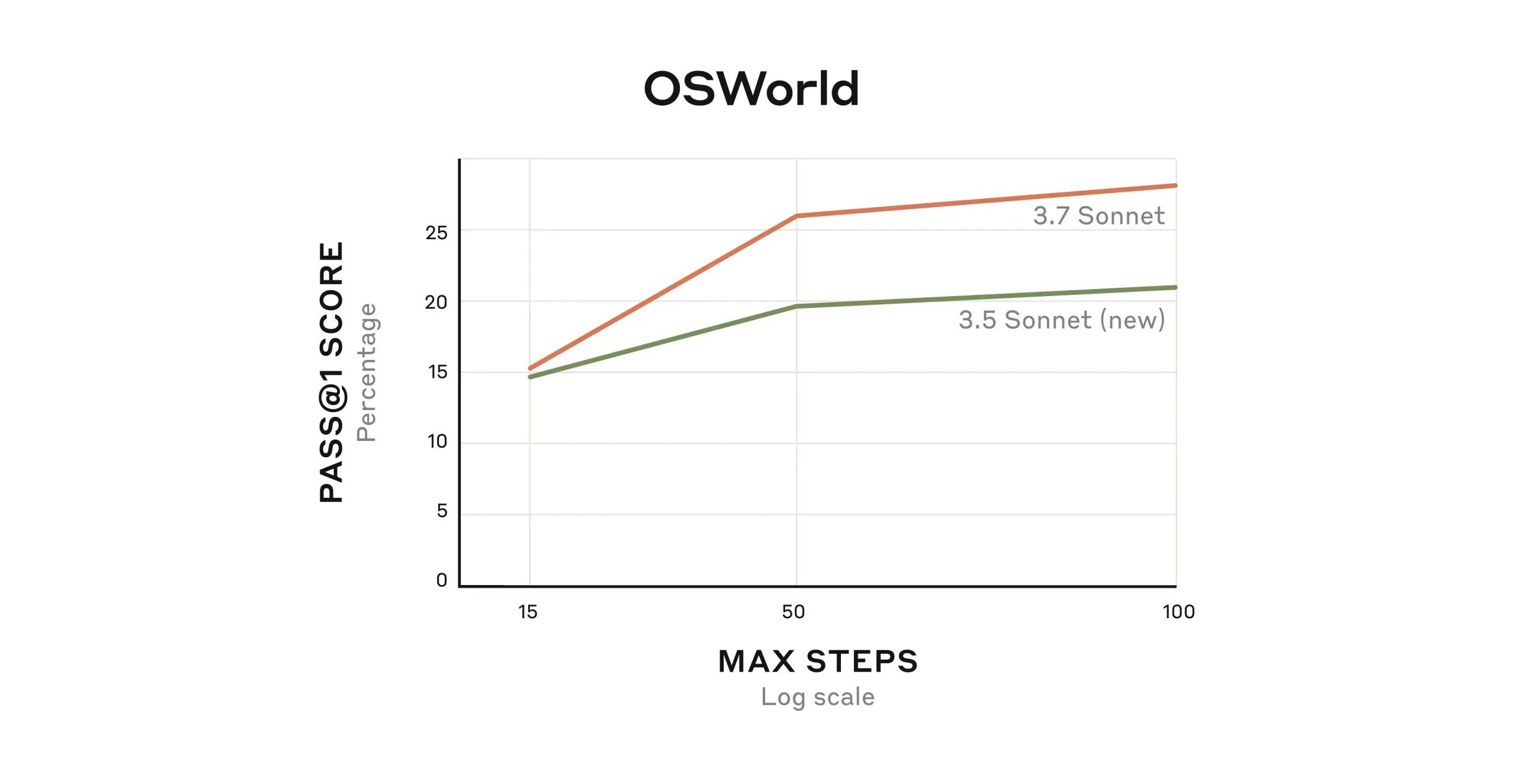

在 OSWorld 评测(一个衡量 AI 计算机操作能力的测试)中,Claude 3.7 Sonnet 表现优异,展示了比前代更强的自主操作能力。更令人惊讶的是,研究人员让 Claude 玩 Game Boy 经典游戏《精灵宝可梦 红版》(Pokémon Red),并观察它的游戏进展。

旧版本的 Claude 甚至无法离开游戏起始地点,而 Claude 3.7 Sonnet 通过一次次尝试不同策略,成功击败了三位道馆馆主。这种 “自适应学习”(Adaptive Learning)能力,意味着未来 AI 可能在自动化任务、智能助手、甚至机器人控制等领域发挥更大作用。

更聪明的计算方式:串行思考 vs 并行思考

Claude 3.7 Sonnet 的思维提升,得益于两种计算方式的优化:

- 串行计算(Serial Compute):在扩展思维模式下,Claude 会在一条推理路径上进行多轮推理,而不是一次性给出答案。这种方式使其在数学推理等任务上的准确率显著提高。

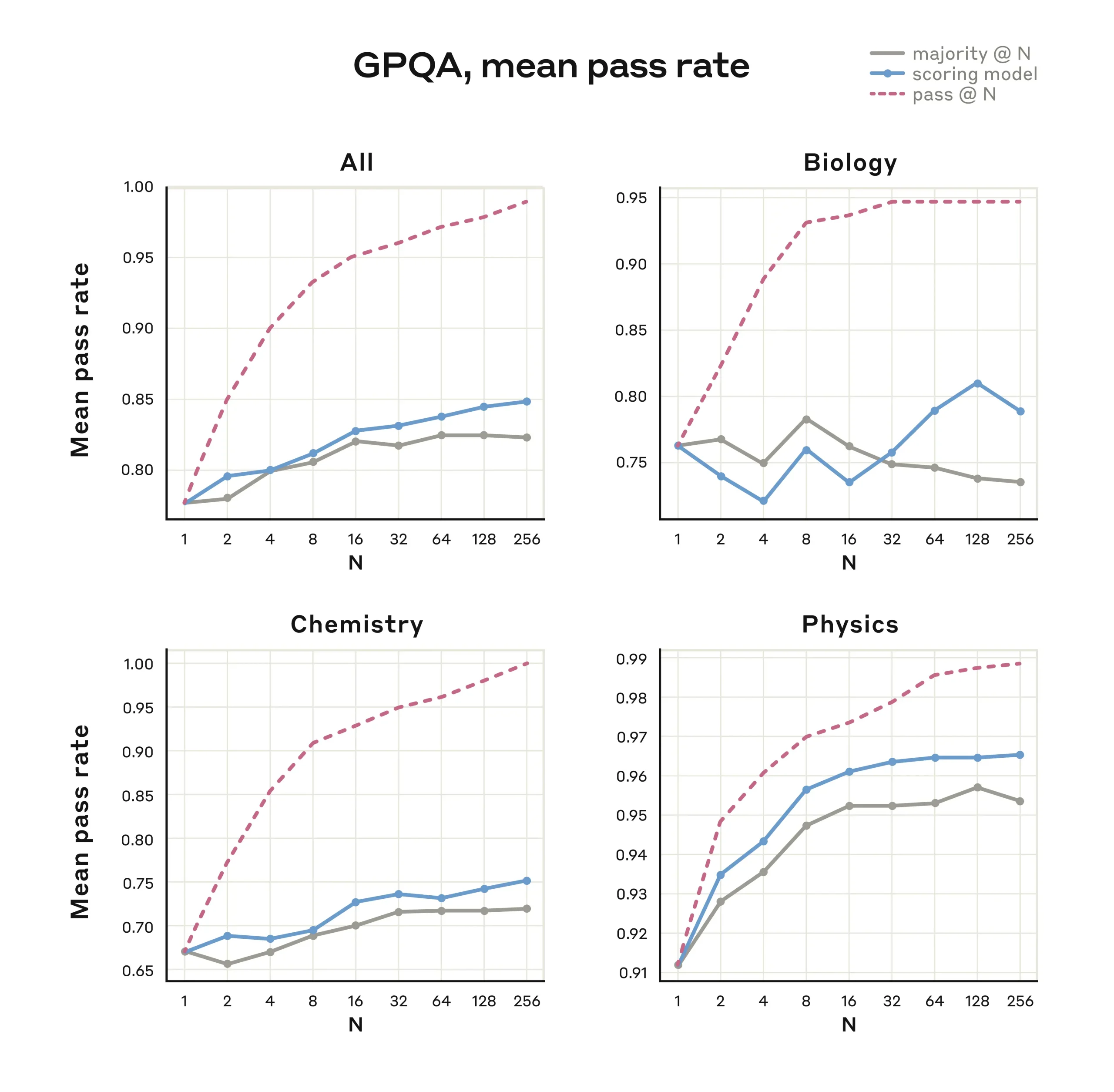

- 并行计算(Parallel Compute):研究人员还尝试了一种新方法,即让 Claude 生成多个不同的推理路径,并通过多数投票(Majority Voting)或评分模型(Scoring Model)来选择最优答案。在高难度科学问题测试(GPQA 评测)中,Claude 3.7 Sonnet 通过并行计算达到了 84.8% 的整体准确率,其中物理题目的正确率高达 96.5%。

虽然目前并行计算方式尚未正式开放给用户,但未来可能会成为 AI 进一步提升智能的重要方向。

AI 安全性:确保更强 AI 依然可控

随着 AI 变得更强大,安全性问题也愈发重要。Anthropic 为 Claude 3.7 Sonnet 设定了 AI 安全等级 2(ASL-2),并进行了严格的红队测试,以确保 AI 不会在涉及化学、生物、放射和核武器(CBRN) 等敏感领域提供危险信息。

此外,Claude 3.7 Sonnet 还采用了多种安全措施,例如:

- 思维过程加密:如果 Claude 生成的思维过程涉及潜在有害内容,系统会自动加密相关部分,并显示提示信息,以确保 AI 不会无意中泄露敏感信息。

- 计算机操作安全防护:Claude 具备在用户授权下操作计算机的能力,因此 Anthropic 采用了 “提示注入攻击防护”(Prompt Injection Defense)技术,以防止恶意第三方通过隐藏指令误导 AI。目前,这种防护的成功率已从 74% 提高到 88%,未来还将继续优化。

未来展望:Claude 3.7 Sonnet 代表 AI 发展的新方向

Claude 3.7 Sonnet 不仅仅是一个更强大的 AI,它的 扩展思维模式、智能体能力、计算方式优化,以及更严格的安全机制,让 AI 的应用范围进一步拓宽。无论是在科研、自动化办公,还是智能助手等领域,这种“更深思熟虑” 的 AI 都将为用户带来更强大的支持。

目前,用户可以在 claude.ai 或 Anthropic API 上体验 Claude 3.7 Sonnet。Anthropic 也欢迎用户提供反馈,以帮助进一步优化 AI 的能力。

AI 的未来,可能比我们想象的更智能、更安全,也更贴近人类的思维方式,而 Claude 3.7 Sonnet,正是迈向这一未来的重要一步。

评论(0)