#世界模型

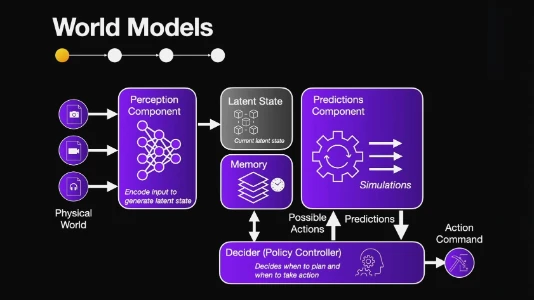

拆解世界模型,四个模块让 AI 真正“理解”物理世界

AI 科普达人 New Machina 拆解世界模型四大核心模块:感知、预测、记忆与决策。该系统通过持续循环的“感知 - 行动”机制,利用预测误差更新权重,实现从文本接龙向物理规律建模的跨越。相比大语言模型的模式匹配,世界模型致力于内化因果关系,为通用智能发展提供关键路径。

生成式 AI 的未来将会怎样?

2025 年 9 月 MIT 举办首届生成式智能体影响联盟峰会,业界领袖共论技术未来。 MIT 校长与教务长强调需确保人类智慧与技术同步进步。杨立昆指出生成式智能体真正的突破口在于研发“世界模型”,即让机器像婴儿般通过感官与物理世界互动来构建对现实的抽象理解。亚马逊 CTO 认为生成式智能体是极具影响力的技术。峰会折射出业界期待正从“更强大的语言能力”转向“更接近人类认知模式的学习机制”。

【AI工具】不是语言模型,也不是图像模型,Luma 的 UNI-1 到底是什么

Luma 推出 UNI-1,一种突破性多模态推理模型:它并非语言或图像模型的拼接,而是将世界理解与图像生成统一于单次前向推理中,实现“先看懂、再画出”。架构上尝试融合逻辑推理与视觉想象,被称作“左右脑合一”,或预示AI建模范式的转向。

什么是 JEPA ,它和世界模型有什么关系?

JEPA(联合嵌入预测架构)不生成像素或token,而是在潜空间中学习数据的抽象表示并预测状态变化,天然承担世界模型中的状态表征与动态预测功能。它更关注“理解与模拟”,而非“生成与表达”,为机器人、自动驾驶等需长期推理与多模态交互的系统提供更高效稳定的基础能力。

科幻照进现实,《十三层空间》中的社会模拟系统真的来了

《十三层空间》式社会模拟成真:Smallville 构建由生成式智能体组成的自主小镇,Simile 平台则基于人类决策建模,支持反事实推演——改一个变量,整个社会重新演算,助力政策制定、商业策略等高风险决策提前验证影响与风险。

1X 发布最新世界模型,称为机器人 NEO 的认知核心

1X为机器人NEO推出全新世界模型,使其能基于视觉与人类交互视频预训练,在脑中预演符合物理规律的动作,再执行真实操作;支持多方案并行、动态环境适应及自我强化学习闭环,显著提升泛化能力与自主性。

Runway 年终 5 大升级 向通用世界模型迈出一大步

Runway 年终发布五大升级,核心是 Gen-4.5 多模态视频模型(支持有声电影生成与音画协同编辑)和通用世界模型 GWM-1;后者涵盖虚拟空间构建(GWM Worlds)、高保真数字人(GWM Avatars)、机器人训练模拟(GWM Robotics),并联合英伟达等共建大规模训练平台。

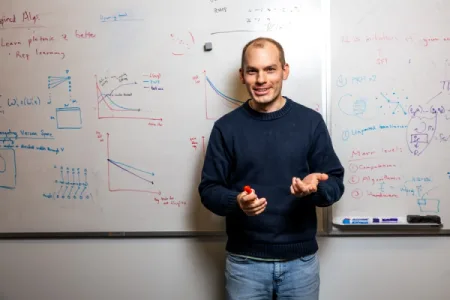

MIT 教授探索类人智能的奥秘

MIT副教授Phillip Isola通过心理物理学实验与视频预测等生成模型,探索人类如何直觉理解物理世界、推断物体功能并预测事件;其研究强调AI与人类认知的双向启发,旨在揭示智能本质的多样性。

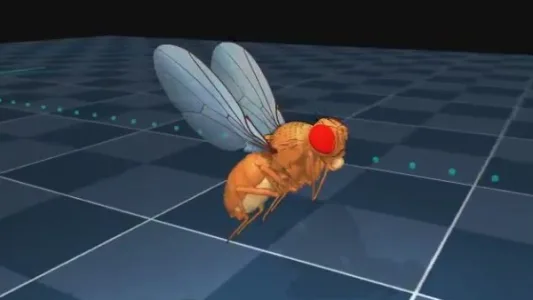

DeepMind 通过神经网络建立果蝇全身物理仿真

DeepMind 基于 MuJoCo 构建高保真果蝇全身物理仿真,集成空气动力学与足部吸附模拟,并用神经网络从真实视频学习运动控制,实现逼真飞行与视觉导航。该“数字果蝇”可解析身体、神经与环境协同机制,技术正延伸至小鼠和斑马鱼。