#Llama

微软推出 BitNet 推理框架,实现 1-bit 大模型本地部署

微软开源 BitNet 推理框架,支持 1-bit/1.58-bit 极致量化,可在单 CPU 上本地运行 100B 级大模型,x86/ARM 平台加速 1.37–6.17 倍,能耗降超 70%,兼容 Llama3、Falcon3 等主流模型,显著降低大模型部署门槛。

如何结合 Llama 4 & MCP 进行多智能体应用快速开发

Llama 4 发布后,开发者可借助 praisonaiagents 框架,结合 MCP 协议、Brave Search 实时检索与 Groq 加速推理,快速搭建多智能体旅行规划系统。系统含研究、航班、酒店、规划等分工智能体,通过 Gradio 提供可视化界面,仅需基础 Python 能力即可实现。

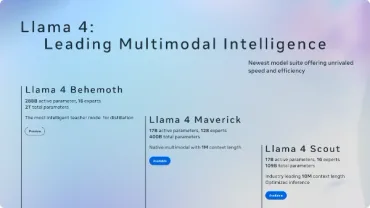

Llama 4 开源大模型家族:开启原生多模态 AI 创新的新时代

Meta开源Llama 4系列,含Scout(1000万Token上下文)、Maverick及训练中的Behemoth,原生支持文本、图像、视频多模态理解;采用MoE架构提升效率,多语言训练规模达Llama 3的10倍,安全与偏见控制显著优化。

如何搭建免费的本地版 Llama 3.2 AI 网络爬虫

无需联网、不依赖API,用本地运行的Llama 3.2 + ScrapeGraphAI搭建自然语言驱动的AI爬虫:输入网址和中文提示,即可自动提取网页结构化数据。全程免费,支持离线使用,适合开发者快速实现定制化信息采集。

使用 Llama 3.2 构建一个本地版 PDF 聊天助手

基于本地部署的 Llama 3.2 模型与 Embedchain+ChromaDB 构建离线 PDF 聊天助手,支持上传 PDF、自动解析内容并用自然语言问答,全程无需联网。使用 Streamlit 搭建简洁交互界面,适合希望在本地安全处理敏感文档的技术用户快速上手。

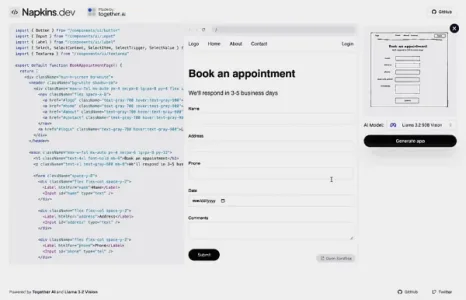

AI 编程神器 Napkins:网线线稿转代码

Napkins 接入 Llama 3.2 Vision 模型,可将手绘线稿或网页草图直接转为可运行的 React + Tailwind 代码,全程免费、无需注册,适合前端开发者快速验证设计原型。

用 Together AI 的 LlamaCoder,一句话生成整个应用

Together AI 推出开源工具 LlamaCoder,用户只需一句话提示,即可调用 Llama 3.1 405B 模型自动生成完整应用(如测验APP、番茄钟等)。上线月余获 GitHub 2000+ 星,已生成超20万应用。依托 Together 推理引擎,实现高性能、低成本部署,助力开发者快速落地开源大模型能力。

OpenAI o1-preview 常识问题推理能力与主流模型的对比

OpenAI新模型o1-preview在常识推理测试中表现亮眼:面对“倒扣杯子放入微波炉后草莓位置”这一物理常识题,它准确推演出草莓留在桌面,并分步阐明逻辑。对比9款主流模型,仅GPT-4o、Claude 3.5和Llama3.1答对,其余包括GPT-4o mini、Gemini-1.5-Pro等六款均出错。