#智能体

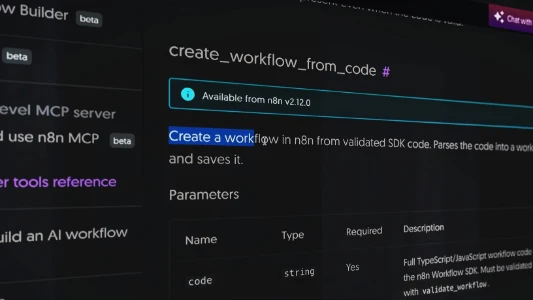

用 Agent 搭建 n8n 工作流,告别手动拖拽时代

n8n 推出全新 MCP 支持,允许 AI 智能体直接创建和编辑工作流,彻底告别手动编写 JSON。团队为此专门设计了新语法与 SDK,实现 schema 验证、数据表构建及流程测试。该功能兼容 Claude Code、Cursor 等主流编程助手,不绑定特定模型,所有用户升级至 2.18.3 版本即可免费使用。这标志着连工作流搭建本身正逐步被智能体替代,为复杂自动化流程的生成带来新可能。

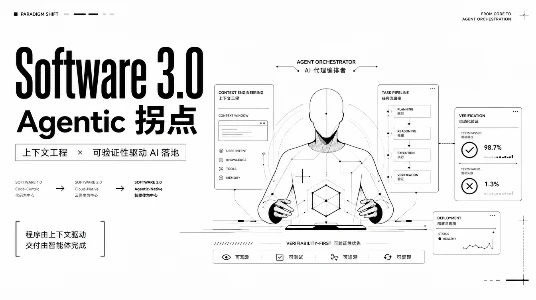

提示词工程已死,上下文工程崛起:Karpathy 最新演讲透露的信号

4 月 30 日,Karpathy 在 Sequoia Ascent 2026 提出 Software 3.0 概念,指出 2025 年 12 月已成为 Agentic 拐点。核心变化在于工作流从编写代码转向编排 Agent,上下文窗口成为新程序杠杆。他强调 AI 落地速度取决于场景是否具备自动化验证信号,而非单纯模型能力。开发者应关注任务的可验证性与训练数据分布,普通用户则需尝试将完整宏观任务交付给 Agent。

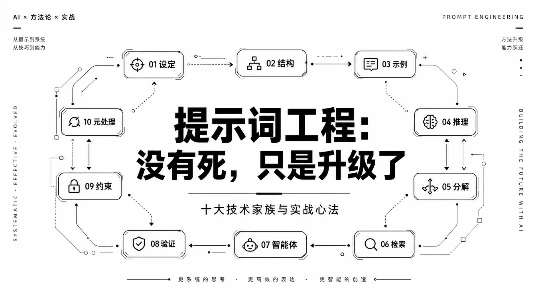

2026 年提示词工程的十大技术家族与实战心法

提示词技术清单已近百种,死记硬背不如掌握“何时用”。文章将技巧归纳为十大家族:设定、结构、示例决定输入,推理、分解引导思考,检索、智能体连接外部世界,验证、约束、元处理保障可靠性。生产级提示词通常组合多个家族,先诊断问题所属家族再选具体手法,比盲目尝试更高效。

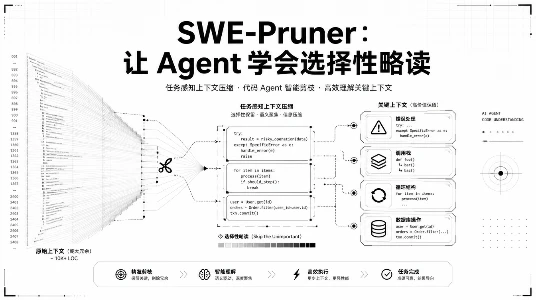

代码 Agent 的上下文减肥药:SWE-Pruner 是怎么让模型少看多想的

针对代码 Agent 上下文昂贵且易迷失的痛点,SWE-Pruner 提出模仿人类“选择性略读”的策略。该方案通过任务目标引导剪枝,利用 0.6B 小模型动态筛选关键代码片段,而非依赖破坏语法的固定指标。实测显示,其在 SWE-Bench 等任务中 Token 消耗降低 23% 至 54%,成功率反而提升。这一思路为长代码处理提供了新方向,尤其适合需要本地部署或边缘计算的 Agent 落地场景。

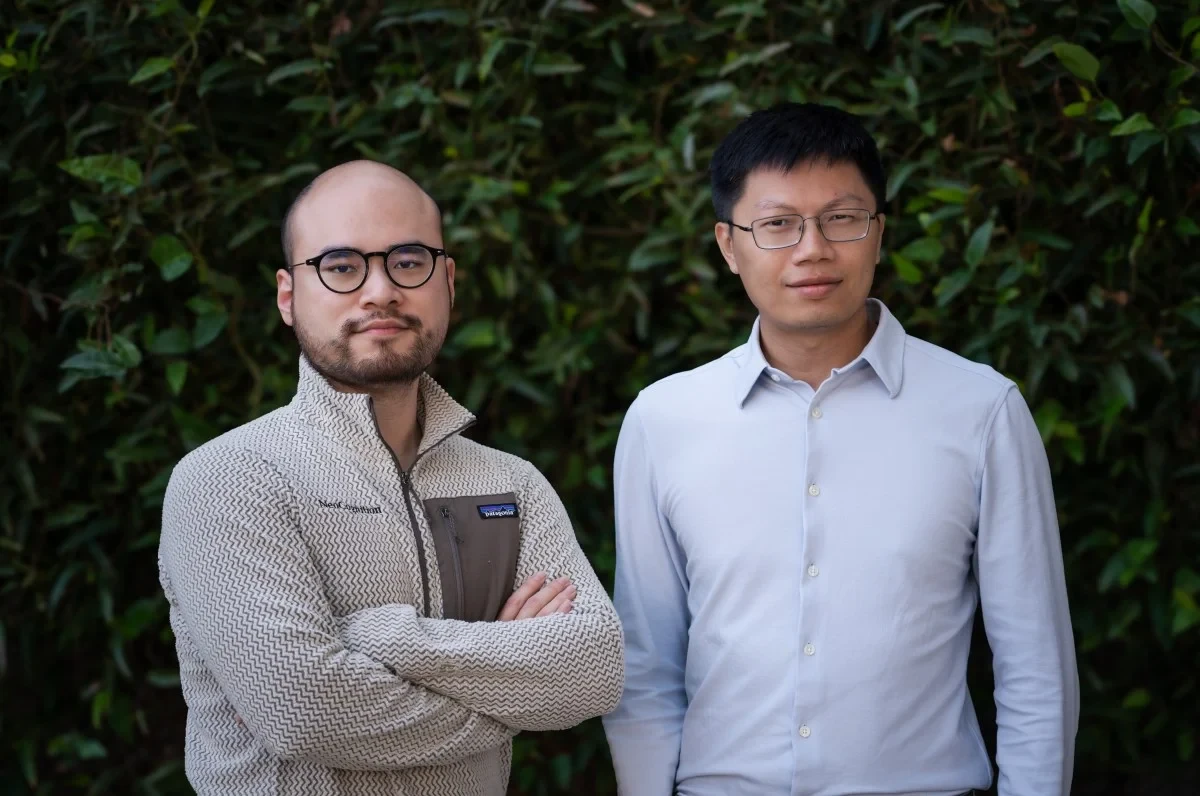

AI 研究实验室 NeoCognition 获 4000 万美元种子轮融资,构建类人学习智能体

NeoCognition 由俄亥俄州立大学教授 Yu Su 创立,获 4000 万美元种子轮融资。团队约 15 人,多为博士,目标不是解决智能体做事不稳定的致命短板!当前智能体任务成功率仅约 50%。公司试图打造能自我学习、快速专业化的智能体系统,让 AI 进入任何领域后都能自主构建“世界模型”,成为真正的“专家”。投资方包括 Vista Equity Partners 等重量级机构, NeoCognition 计划将产品卖给企业客户,特别是 SaaS 公司。融资背后反映 AI 市场正从追逐“大模型”转向追求“更可靠的执行”。

微软开源 Agent Governance Toolkit:AI Agent 的安全终于有人管了

微软开源 Agent 治理工具包 AGT,覆盖 OWASP 全部 10 类安全风险。该工具借鉴操作系统模型,通过工具扫描、调用前策略检查及响应审查三层机制,将安全从提示词建议升级为代码硬约束。其策略评估延迟不足 1 毫秒,支持多语言及主流框架集成。在监管趋严背景下,AGT 为开发者提供了管控 Agent 外部动作的有效基础设施,虽不干预内部推理,但填补了当前执行层的安全空白。

没装摄像头的 AI 眼镜,如何成为第二大脑

Mira 是一款主打 “记忆 + 执行” 的 AI 智能眼镜,通过持续录音将对话转化为可搜索的个人上下文档案。它不仅能实现 900 毫秒内的多语言实时字幕翻译,还能基于记忆自动处理邮件、日程及支付等任务。配合支持手势操作的戒指,用户无需掏手机即可交互。设备仅重 39 克且无摄像头,承诺不利用对话数据训练模型,适合追求隐私与高效语音助手的用户。

Pika 推出创作智能体,将聊天窗口变成一个“人”

Pika 推出创作智能体,将传统的图片视频生成提示词窗口升级为拥有形象、声音与个性的虚拟“人”。这一变化虽未改变底层技术逻辑,却把工具操作转化为拟人化交流体验。用户不再面对枯燥的输入框,而是能与有性格的智能体互动,为内容创作过程增添更多趣味与便捷。

Stitch 应用 DESIGN.md 设计规范现已开源

Google Labs 开源 DESIGN.md 草案规范,目标是建立一套 AI 可读取的设计规则共享语言,让智能体能理解品牌意图并校验无障碍标准。其核心价值在于为生成式设计工具补上语义层,使设计从“看着像”升级为“规则一致、语义一致”。若该规范被广泛采用,设计系统核心资产可能从组件库转向可执行规则文档,这标志着 AI 设计工具从“能生成”向“真的能用”迈进的关键一步。