ChatGPT 开始卖广告了,但 OpenAI 真正的野心在语音

5 月 7 日,OpenAI 在英、巴等五国启动 ChatGPT 广告内测,并推出三款具备 GPT-5 级推理能力的实时语音模型。广告业务强调隐私与回答独立性,旨在探索免费用户变现路径。新语音模型则支持复杂任务操作,加速企业付费场景落地。此举标志 OpenAI 从技术验证转向商业模式规模化,证明 AI 产品可兼顾用户体验与多元盈利,为行业商业化提供了关键风向标。

如何解决 Hermes Agent 中 QQ Bot “灵魂不在线”

Hermes QQ Bot 常因网络波动出现“灵魂不在线”的静默断连,根源在于 WebSocket 重连逻辑缺陷导致进程未正常退出。目前修复版本已解决重连耗尽问题,但深层异常捕获仍有待完善。建议用户升级至最新版,配置 systemd 或 Docker 自动重启策略,并优化代理超时设置,以保障 QQ Bot 稳定运行。

一个 JSON 公式,让 AI 出图告别抽卡玄学

AI 技术博主 AI Master 提出用 JSON 结构化提示词替代自然语言,解决 AI 绘图修改局部时整体崩坏的问题。该方法将主体、灯光等元素独立分槽,配合 Gemini 提取参考图信息,可实现精准调整颜色或风格而不影响其他细节。此方案适用于角色一致性控制及摄影参数迁移,同样兼容 Veo 3.1 视频生成,让 AI 创作从随机抽卡转向可控的确定性系统。

2026 年 AI 工具全拆解,一个公式搞定所有提示词

AI 技术博主 AI Master 指出,多数用户效果平平源于未掌握底层逻辑。它拆解了语言、图像及视频三大模型的运作机制,并梳理了 2026 年主流工具格局。针对提示词,AI Master 提出文本需明确上下文与角色,图像遵循六要素公式,视频则强调单一动作与环境设定。核心观点在于将 AI 视为需清晰简报的新人,通过迭代而非一次搜索来优化产出,适合希望提升各类生成效果的创作者。

让 AI 视频拥有电影质感的九层结构提示词

如何让 AI 视频拥有电影质感?提示词应采用导演语言而非被动描述,需包含主体、微动作、环境、摄像机、灯光、风格、情绪、物理细节、渲染质量九层结构。文章还总结了微动作工程、摄像机定义、布光逻辑、情绪编码及可控混乱等策略,并提供了多条完整示例。创作者需注意框架易致同质化,真正的竞争壁垒在于对细节分寸和不可模板化判断的把握。

上下文工程实战:让 AI Agent 在超长对话中不失忆的三大策略

GPT-5.5 等模型虽推理强劲,却常因“上下文衰退”在长任务中遗忘关键信息。文章剖析滑窗截断、分层摘要及记忆卸载三大策略,指出单纯扩大窗口无效,需构建外部记忆架构。通过热温冷三层结构与增量更新机制,可显著提升多步骤工程任务的稳定性与 Token 利用率,为开发长程 AI Agent 提供核心设计思路。

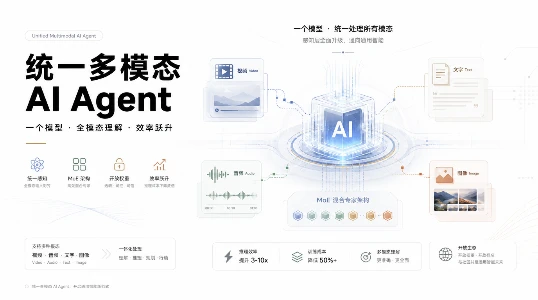

NVIDIA 开源 Nemotron 3 Nano Omni:一个模型通吃视频音频文字

NVIDIA 开源 Nemotron 3 Nano Omni,以 30B 总参数、3B 激活的混合专家架构,实现视频、音频与文字的统一处理。该模型通过 Mamba 与 Transformer 结合及高效视频采样技术,将多模态推理吞吐量提升最高 9 倍,显著降低延迟与显存占用。相比传统三模型拼接方案,它更适合构建高并发 AI Agent,支持本地消费级显卡运行,已在文档智能、客服等场景验证实际价值。

NVIDIA 给 ComfyUI 装了三把刀:拆层、擦除、转3D,本地一条龙搞定

NVIDIA 开源 GenAI Creator Toolkit,为 ComfyUI 提供三个核心本地工作流:一键图像分层、精准物体擦除及照片转 3D 模型。该工具利用深度估计与生成式 AI 技术,解决商业设计中抠图繁琐、修图不自然及 3D 建模门槛高的问题。支持 RTX 显卡在本地运行,保障数据安全,适用于需要高效处理视觉素材的设计师、视频师及 3D 美术人员,标志着 ComfyUI 向通用创作执行器的关键转变。

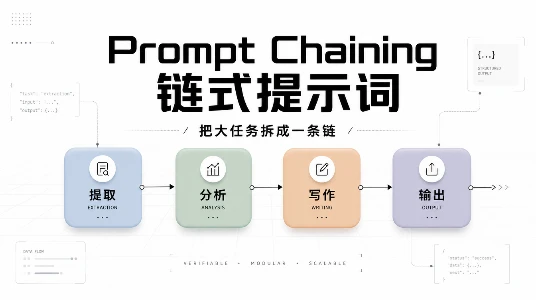

一条提示词干不完的活:Prompt Chaining 实战指南

面对复杂任务,单条提示词常因上下文溢出、错误累积和职责混杂导致失败。Prompt Chaining 通过将大任务拆解为提取、分析、写作等独立步骤,显著提升输出质量与可控性。文章详解顺序链、条件路由链及并行链三种核心模式,提供从用户反馈分析到客服系统的实操模板,并指出信息衰减、格式不兼容等避坑要点。无论是个人开发者还是企业团队,掌握链式调用都能以更低返工成本实现高精度自动化处理。