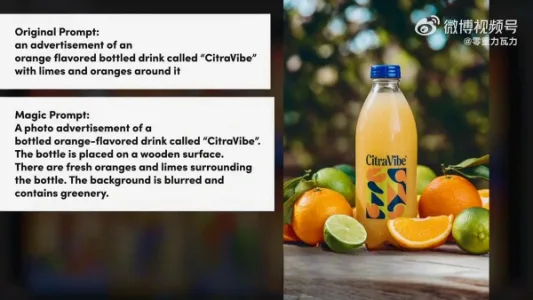

Ideogram 官方教程:1分半讲解绘图全流程

Ideogram官方发布90秒短视频教程,清晰演示从输入提示词到生成图像的完整流程,界面简洁、操作直观,适合新手快速上手AI绘图。

Ideogram 创意 AI 绘画官方教程

Ideogram 2.0 正式发布,图像质量已逼近 Midjourney,尤其在文字生成、风格转换与 Remix 重绘功能上表现更优,为中文用户提供了稳定可用的替代方案。

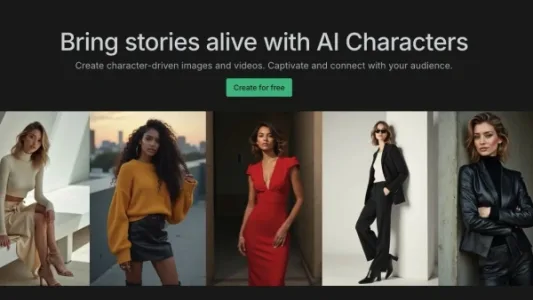

RenderNet:最专业简单的虚拟网红制作流程

RenderNet 提供端到端虚拟网红制作流程:支持上传头像或文本提示生成统一形象的高质量人像,内置 Flux 模型与图片超分功能,无需训练 LoRA;可导出图像至可灵、Runway 等工具生成短视频,适配美妆、旅游、穿搭等多场景内容创作。

AI 创意视频工作流:一个人完成整部动漫 MV

AI创作者enigmatic_e演示单人制作动漫MV全流程:实拍行走与演唱,用Viggle转绘为卡通绿幕素材,Animatediff优化动画流畅度,LivePortrait将歌声驱动的面部表情精准同步至角色,最后合成背景——无需专业团队或复杂设备。

Runway 运动笔刷 (Motion Brush) 正确的使用姿势

Runway 运动笔刷(Motion Brush)目前仅兼容 Gen-2 模型,可在视频中对局部区域精准添加运动效果;Gen-3 版本暂未支持该功能。使用时需确保选择 Gen-2 模型,才能实现动态编辑。

如何精准控制 AI 视频的色调

用16进制颜色码(如#ff0000)替代“红色”等模糊色名,可显著提升AI视频色调控制的精准度与复现性,支持单色场景、多元素独立配色及渐变过渡,在Luma、海螺AI、Runway、可灵等主流平台已验证有效。

Runway 的运动笔刷(Motion Brush)对图片局部进行动作控制

Runway 推出运动笔刷(Motion Brush)功能,可在 Gen-2 中对图片指定区域添加简单动态效果,实现局部动作控制;目前 Gen-3 尚未集成该能力,用户需切换至 Gen-2 使用。

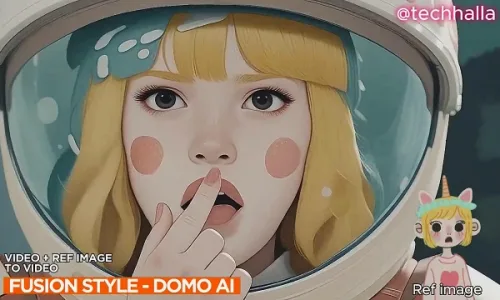

Flux LoRA 结合 DomoAI Fusion 创意视频制作工作流

TechHalla 展示了一套高效创意视频工作流:先用 Flux LoRA 生成高细节、强风格的分镜图(如复古未来宇航员、暗黑领主等),再通过 Runway 或可灵图生视频,最后借助 DomoAI Fusion v2 据参考图进行高保真风格融合,显著提升视频质感与画面一致性。

Runway Gen-3 视频风格转换介绍

Runway Gen-3 Alpha 新增视频风格转换功能,支持用提示词自由定义艺术风格(如3D卡通、粘土、玻璃等),无需预设选项;Structure Transformation 参数可精准控制结构变化程度,设为0即仅换风格不改内容,且自动清除原视频水印。