Gemini 3.1 Flash TTS :下一代富有表现力的 AI 语音技术

Google 发布 Gemini 3.1 Flash TTS 语音合成技术,实现可控制性、表现力和音质三维升级。该模型在 Artificial Analysis 评测中位列“最具吸引力象限”,支持 70 多种语言和多说话人对话。其核心创新的音频标签( Audio Tags )功能可将自然语言指令嵌入文本,实现精细化语音风格控制,降低了专业音频制作门槛,标志着语音合成从“能说”向“会说”的关键跃迁。所有生成音频均嵌入 SynthID 水印,可靠识别 AI 生成内容,对有声内容创作、虚拟助手、游戏配音等场景具有实用价值。

Allbirds 出售鞋业后转型押注 AI

Allbirds 更名 NewBird AI ,全面转型 GPU 云服务赛道。原鞋履业务以 3900 万美元出售,上市公司“借壳”切入 AI 算力租赁市场,同时获 5000 万美元融资承诺。这背后是资本追逐热点的务实逻辑。AI 算力需求旺盛, GPU 资产不愁买家。然而 AWS 、谷歌云、 CoreWeave 等巨头早已布局, NewBird AI 若仅靠融资买卡,缺乏差异化竞争力,恐难逃“概念炒作”嫌疑。交易尚需股东表决。

印度 vibe-coding 创业公司 Emergent 进军 AI 智能体领域

印度 Emergent 公司发布智能体 Wingman ,通过 WhatsApp 、 Telegram 等通讯平台与用户交互,在后台连接邮件日历等企业工具自动执行任务。该产品采用“信任边界”设计,常规任务自动完成,敏感操作需用户确认。 Emergent 的 vibe-coding 平台已积累 800 万创作者,完成 7000 万美元融资,估值达 3 亿美元。其策略是轻量化嵌入现有聊天界面,而非另建操作界面。分析认为,智能体竞争正从模型能力转向用户触达路径,“信任边界”设计兼顾了用户信任与产品采纳。

Anthropic 十万亿参数模型 Mythos 震撼登场,暂不公开发布

暂无摘要,点击查看全文与评论。

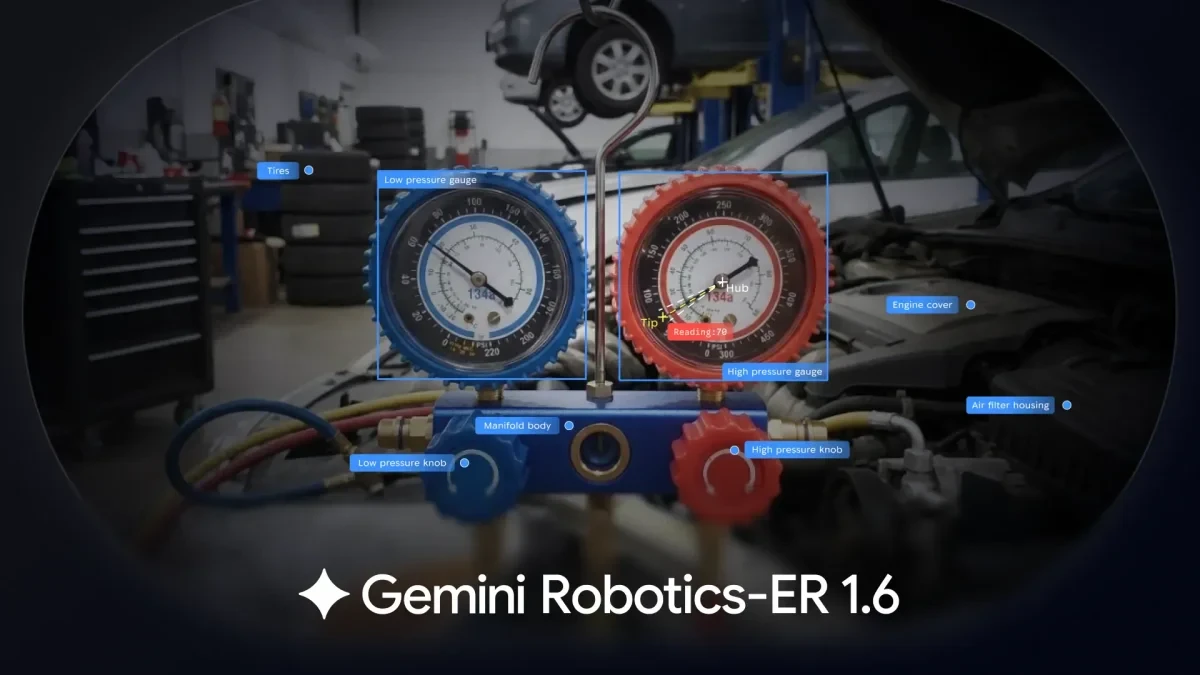

Google DeepMind 发布 Gemini Robotics-ER 1.6

Google DeepMind 发布 Gemini Robotics-ER 1.6 推理模型,强化机器人的空间感知和物理推理能力。该版本与 Boston Dynamics 合作开发,支持解读模拟仪器读数,可通过 API 集成使用,在精准指向和物理任务检测方面优于前代。这标志着大语言模型正从“理解指令”向“落地执行”迈进,物理智能体有望从实验室走向更广泛的工业应用场景。

LinkedIn 数据显示 AI 还不是招聘减少的罪魁祸首

LinkedIn 高管 Blake Lawit 在世界经社论坛上表示,自 2022 年以来招聘规模下降约 20%,但 AI 并非主因,真正推手是利率上升。 LinkedIn 数据显示,被认为最易受 AI 冲击的客户服务、行政管理等领域并未出现预期冲击效应,大学毕业生与职业中期人群的招聘降幅基本相当。不过 Lawit 发出警示:近年来普通工作所需技能已变化约 25%,预计到 2030 年将攀升至 70%。真正的挑战或不在岗位减少,而在于劳动者技能更新压力远超以往,这对政策制定者与企业 HR 提出了新要求。

Hightouch ARR 突破 1 亿美元, AI 驱动营销工具助力增长

初创公司 Hightouch 推出 AI 内容生成服务,帮助营销人员快速制作品牌化广告, 20 个月内新增 7 千万美元 ARR ,总 ARR 突破 1 亿美元。其通过对接 Figma 、图片库等品牌资产,让 AI 学习并保持品牌调性,产出专业级图像。已融资 8000 万美元,估值 12 亿美元,并体现 AI 从通用能力向品牌精细化的行业趋势。

OpenAI 更新 Agents SDK ,助力企业构建更安全智能体

OpenAI 发布 Agents SDK 重大更新,推出沙盒隔离机制和前沿模型测试框架。沙盒功能为智能体提供独立工作空间,解决自主运行时的安全隐患。测试框架支持企业部署最先进 AI 能力。用户现已可通过 API 使用新功能,首发支持 Python ,标志着企业在复杂 AI 应用开发上迈出关键一步。

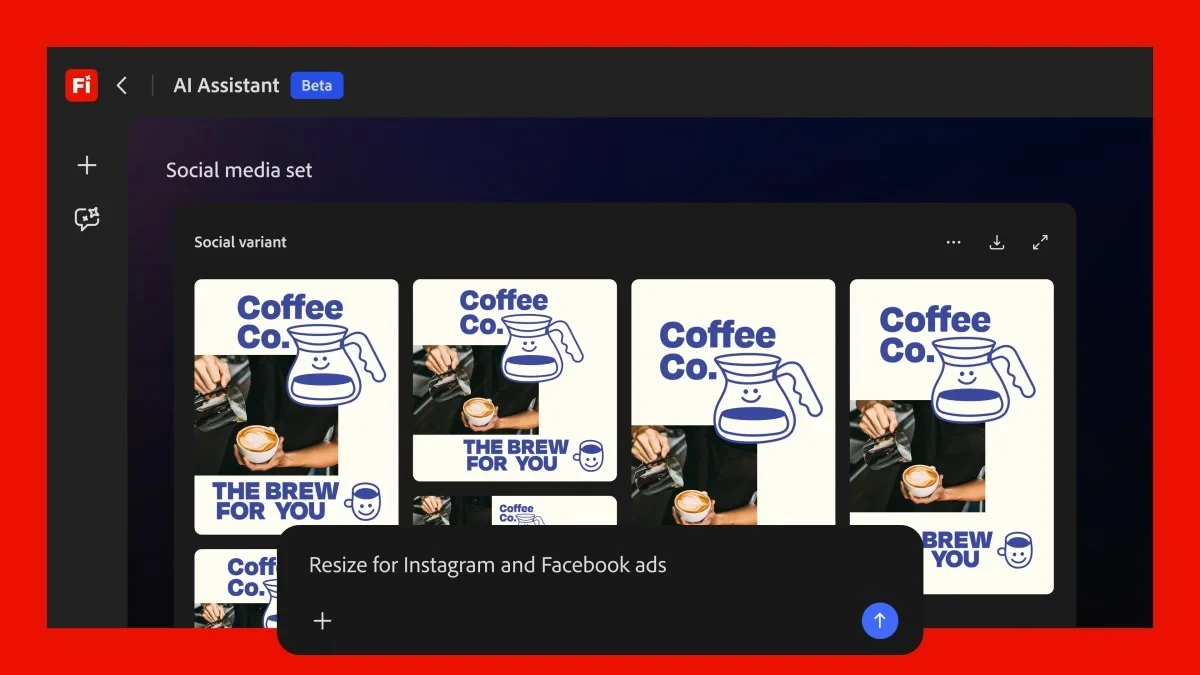

Adobe 新 Firefly 智能体上线,可调用 Creative Cloud 完成任务

Adobe 推出 Firefly AI Assistant ,定位为跨全家桶执行复杂任务的 AI 智能体。核心能力是跨应用协同,能在 Photoshop 、 Premiere 、 Illustrator 等工具间自由切换,自动完成从图片编辑到视频处理的全流程。界面设计融合文本指令与传统操作,保留用户介入通道,并具备根据使用习惯提供个性化建议的能力。 Adobe 此举意在将 AI 从响应式交互推向自动化执行层面,是对抗 Canva 、 Figma 等竞争者的关键差异化战略。