Meta 推出新的 AI 视频生成模型:VideoJAM,运动表现超越 Sora。VideoJAM 不仅能够生成外观逼真的视频,还能让视频拥有更加自然流畅的运动效果。传统的视频生成模型往往比较注重画面细节,容易忽略动作的连贯性,导致生成的视频看起来不够真实。为了解决这个问题,VideoJAM 在训练的过程中同时学习画面和动作,并将两者结合在一起。在生成视频时,它还会使用一种叫 Inner-Guidance 的方法,根据模型自己预测的动作,不断调整画面生成的方向,确保动作更加自然流畅。不需要额外的数据或复杂改动,VideoJAM 就能用在各种视频生成模型上。无论是跳舞、各种运动还是慢动作特写,VideoJAM 都能生成更真实、更协调的视频!

相关文章

AI 产品工具

2026年6月1日

0 条评论

小创

一段代码让网站出海,这个 AI 翻译工具把多语言 SEO 玩明白了

跨境电商网站常因语言壁垒导致高跳出率。Weglot 是一款 AI 翻译工具,仅需几分钟即可通过添加脚本实现网站多语言本地化,且保持原有排版。该工具支持可视化编辑、术语表锁定及团队协作,便于后续维护。同时,它能自动优化 hreflang 标签、独立 URL 及元数据,解决多语言 SEO 难题。借助母语内容布局小语种市场,企业可以低成本获取流量红利,有效提升海外转化率。

阅读全文

AI 产品工具

2026年6月1日

0 条评论

零重力瓦力

SCOPE 给 AI 绘画装上了 “语义追踪器”,复杂提示词终于不用反复抽卡了

中科大团队发布 SCOPE 框架,通过结构化语义规格解决 AI 绘画中复杂提示词语义丢失问题。该系统将提示词拆解为实体、约束及未知项,构建包含分解、合成、生成、验证的四步循环,并辅以检索、推理和修复技能,实现生成过程全程可追溯与精准修复。团队还推出 Gen-Arena 评测基准及 EGIP 指标。实验显示 SCOPE 在多项基准中表现优异,为多元素控制场景提供了工程化解决方案,代码已开源。

#AI 绘画

阅读全文

AI 产品工具

2026年5月28日

0 条评论

零重力瓦力

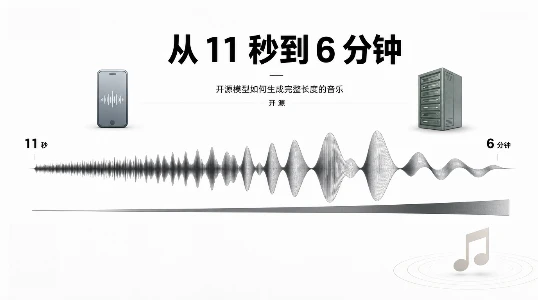

Stable Audio 3.0 发布:开源音频生成从 11 秒走到 6 分钟

Stability AI 发布开源音频模型 Stable Audio 3.0,最长可生成 6 分 20 秒立体声音频。该模型采用 SAME 架构实现 4096 倍压缩,支持变量长度生成与局部编辑,Small 版本可在移动端离线运行。训练数据均获授权,规避版权风险。提供四个变体及 LoRA 微调文档,社区许可允许商用。此次升级标志着开源音频生成从短音效迈向完整歌曲创作,为开发者提供了本地化、合规的高质量音频生成方案。

#开源模型#AI 音乐

阅读全文

互动讨论

评论区

围绕《Meta 推出新的 AI 视频生成模型:VideoJAM,运动表现超越 Sora》展开交流,未登录用户可浏览评论,登录后可参与讨论。

评论数

0

登录后参与评论

支持发表观点与回复一级评论,互动后将同步到消息中心。

暂无评论,欢迎成为第一个参与讨论的人。