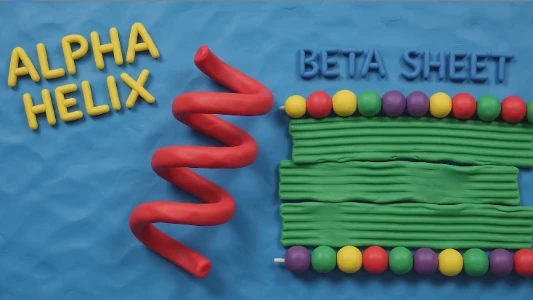

由 AI 视频达人 Kabooki 借助阿里视频生成模型 Wan 2.1 制作的一部动画短片。

Wan 2.1 是阿里推出的一款开源视频生成模型,可本地部署,在 ComfyUI 中使用。

模型下载地址:https://github.com/Wan-Video/Wan2.1

或者可以通过通义万相免费使用,目前生成一段视频需要等待 10-30 分钟。

由 AI 视频达人 Kabooki 借助阿里视频生成模型 Wan 2.1 制作的一部动画短片。

Wan 2.1 是阿里推出的一款开源视频生成模型,可本地部署,在 ComfyUI 中使用。

模型下载地址:https://github.com/Wan-Video/Wan2.1

或者可以通过通义万相免费使用,目前生成一段视频需要等待 10-30 分钟。

一个 15 人团队在 14 天内通过10.8万次生成,制作出一部90分钟的AI长片并入围戛纳影展。创作博主ADIL分享了制作过程,包括将影片从 110 分钟剪至 90 分钟、修复 40 个场景,并展示了三个典型问题场景的修复案例。他总结了28 个技巧,涵盖提示词、前期制作、团队协作和剪辑。关键技巧包括:情感场景需描述身体细微反应以消除“机器人感”.图像提示词应指定镜头焦距、光圈等参数,避免空泛描述。避免正面视角,使用四分之三或天花板角度。通过 X 轴 Y 轴百分比坐标系统精确控制角色位置。

Google I/O 大会上,DeepMind 团队推出全新多模态视频模型 Gemini Omni,被视为视频领域的 “Nano Banana”。该模型从底层架构重新设计,支持图像、视频和音频混合输入,通过日常语言即可完成复杂视频编辑。其核心优势在于高可控性和时间维度感知,例如可让画面中的物体凭空消失或改变摄像机视角,同时保持背景与动作一致。用户仅需提供几张照片和一段语音,即可生成高度还原的个人虚拟分身。Omni 还展现出未经过专门训练的涌现能力,如自动同步视频与音乐节奏、根据剧情逻辑续写场景。

如何让 AI 视频拥有电影质感?提示词应采用导演语言而非被动描述,需包含主体、微动作、环境、摄像机、灯光、风格、情绪、物理细节、渲染质量九层结构。文章还总结了微动作工程、摄像机定义、布光逻辑、情绪编码及可控混乱等策略,并提供了多条完整示例。创作者需注意框架易致同质化,真正的竞争壁垒在于对细节分寸和不可模板化判断的把握。

围绕《阿里 AI 视频生成模型 Wan 2.1 动漫演示》展开交流,未登录用户可浏览评论,登录后可参与讨论。