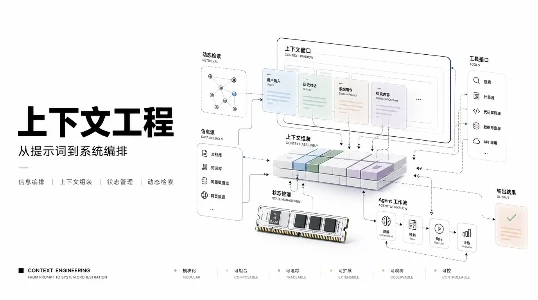

随着大语言模型的广泛应用,其知识局限性日益凸显。如果某个信息不在训练数据中,模型就无法准确回答。为了解决这个问题,目前主要有两种技术路线:检索增强生成(RAG)和缓存增强生成(CAG)。

RAG 采用"按需检索"的方式工作。当用户提出问题时,系统会先查询外部知识库,找出最相关的文档片段,然后将这些内容连同用户问题一起输入给语言模型。这种方式的优势在于可以处理海量知识库,且支持实时更新。比如在法律咨询场景下,新的判例和修正案可以随时被索引使用,无需重训练模型。

而 CAG 则采取"预加载"策略,把所有可能用到的知识提前装入模型的上下文窗口中。这种方式省去了检索环节,响应更快,但受限于模型的上下文长度。对于产品手册这类相对固定且体量适中的知识库,CAG 往往是更好的选择。

有趣的是,这两种方案并非非此即彼。在复杂场景下,它们可以优势互补。以临床决策支持为例,可以先用 RAG 从病历库中检索出相关病例,再用 CAG 维持医生问诊过程中的连续对话,既保证了知识的全面性,又提供了流畅的交互体验。

从技术演进的角度看, RAG 和 CAG 代表了两种不同的知识处理范式。RAG 更像是传统搜索引擎的进化,而 CAG 则展现了一种全新的认知模式。随着大模型上下文窗口的扩展,这两种方案的边界可能会逐渐模糊,但它们折射出的核心问题依然值得深思。在人工智能时代,我们该如何更好地组织和调用知识?这不仅是技术选型的问题,更涉及到知识的本质。也许在未来,我们会发展出更多元的知识增强方案,但目前 RAG 和 CAG 的实践已经为我们提供了宝贵的思考起点。