教皇谈 AI 风险的帖文,可能也是 AI 写的

Pangram Labs 更新了一款 Chrome 扩展程序。用户刷 Reddit 、 X 、 LinkedIn 、 Medium 和 Substack 时,它会实时给内容打标签,判断是“人工撰写”、 “AI 生成”,还是“AI 辅助起草”。这项功能本周面向公众推出,付费版月费 20 美元。它最抓人眼球的一次识别结果,是把教皇官方 X 账号中的多条帖文判定为 AI 生成,其中就包括讨论人工智能如何侵蚀人类判断力的内容。

这篇报道从一个 Reddit 帖子切入。周一,一个刚注册的新账号出现在 r/AmItheAsshole 板块,发帖询问自己拒绝帮继母照看孩子是否过分。帖文语气平实,语法干净,讲的是继母和父亲常常临时要求自己承担育儿责任,最后闹出争执。结尾还写得颇为克制,说自己明白带孩子压力很大,但也觉得这不该成为自己的义务。评论区大多站在发帖人一边,认为孩子不是发帖人的责任,甚至有人建议尽快搬出去。

问题在于, Pangram Labs 的 AI 检测系统认为,这段家庭纠纷故事并不是人写的,而是 AI 生成内容。那条帖子后来被删除,发帖人也没有回应媒体关于是否使用 AI 的询问。

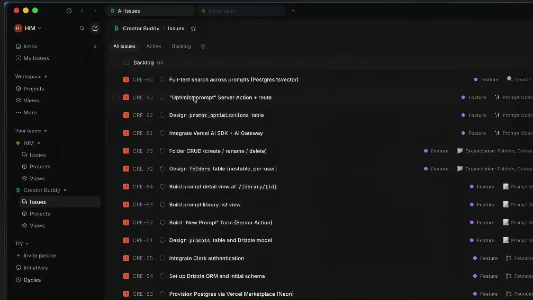

Pangram Labs 对自家系统的说法很激进。公司宣称准确率达到 99.98%,误报率仅为万分之一。新版本 Chrome 扩展会在用户浏览社交平台时实时分析内容,并附带“低”“中”“高”的置信度判断。公司首席执行官 Max Spero 把自己称作“slop janitor”,直译是“垃圾内容清道夫”。他的想法很直接。让用户复制文本、打开外部工具、再粘贴检测,这一步太麻烦。多数人不会这么做。把识别能力直接塞进浏览器,才有可能真正改变日常阅读行为。

这种产品能引发关注,不只是因为网络上假故事越来越多,还因为 AI 生成内容正在大规模渗入互联网。斯坦福大学、伦敦帝国学院和互联网档案馆本月发表的一项研究显示,到 2025 年,至少部分由 AI 生成的新网站已经占到全部新网站的三分之一以上。那项研究使用的,正是 Pangram 较早期的检测工具。 AI 垃圾内容正在同时稀释新闻可信度,也污染社交平台的信息环境,这已经不是一句泛泛而谈的担忧。

当然,像 r/AmItheAsshole 这样的论坛,本来就不缺编造故事的钓鱼帖。夸张、离谱、专为骗互动而写的虚构内容,早就是那里的一部分。真正麻烦的是那些“不离谱”的文本。它们平淡、顺滑、没有明显破绽,普通读者很难起疑。 Pangram 抓住的正是这类边界地带。

就检测能力而言, Pangram 目前在学界评价不低。多所高校的第三方研究都认为它的稳定性和准确性处在前列。 2025 年,芝加哥大学一项审查 AI 检测软件的研究给了 Pangram 最高评级,并特别提到它在较长文本上的误报率几乎为零。 Spero 解释说,系统之所以比不少竞争对手更强,一个原因是训练数据里包含了更多“难样本”,也就是那些处在人类写作和 AI 写作边界附近的文本。报道作者在 WIRED 已发表文章上进行测试时,也没有成功诱发误报。

扩展程序上线后,一个很直接的效果是,它让人迅速看到互联网日常阅读内容里到底有多少可能出自 AI 。最让人意外的一组样本,来自教皇官方账号 @Pontifex 。

4 月 17 日,这个账号发出一则帖文,开头称天主教徒“可以在数字革命背景下成为新 humanism 的先驱”。 Pangram 的扩展把这条标记为人工撰写。但紧接着的三条帖文,讨论人工智能如何塑造思维方式和社会结构,却都被标记为 AI 生成。其中最后一条写道,“当模拟成为常态,人类的辨别能力就会被削弱。”这句话本身像是在警告 AI 时代的风险,结果却被检测工具认定很可能就是 AI 写出来的。那种反讽意味,确实有点重。

教皇 Leo XIV 其他一些 X 帖文也触发了同样的结果,包括谈及乌克兰和中东战争的内容,以及呼吁“更公平分配财富”的帖文。 Spero 的判断很现实。他说,教皇显然不会亲自运营自己的 Twitter 账号,背后肯定有社交媒体人员,但从这些文本看,团队“显然至少在某种程度上使用了 AI”。梵蒂冈没有回应相关置评请求。

这种情况并不只出现在宗教机构账号上。很多对长帖蓝勾博主本就抱有怀疑的 X 用户,看到这类结果大概会觉得自己的直觉被证实了。 Medium 和 LinkedIn 上, AI 垃圾内容同样随处可见。哪怕只粗略扫一眼 Substack 的热门作者榜,也能看到不少被工具标成 AI 的帖子。

但现实并不是简单的“人类作者对 AI 深恶痛绝”。不少写作者已经公开承认,自己会把 AI 辅助工具纳入写作流程。科技记者 Alex Heath 就使用 Claude Cowork 帮助撰稿,并把文章发布在 Substack 上。他甚至给 Claude 提供了具体指令,让它尽量贴近自己的文风和语气。

如果把范围从社交信息流扩大,情况只会更复杂。 Pangram 扩展原本就支持用户手动选中网页任意文字做检测。用这个功能去扫更广泛的公开文本,会发现更多看似“正式”的写作也可能被标记。报道提到, Apple 即将卸任的首席执行官 Tim Cook 在 4 月 1 日公司 50 周年之际发布的一则公开信息,也被打上了 AI 阳性标签。 Apple 没有立即回应媒体询问。

说到底,这类实时检测工具真正改变的,不是某一条帖文的真伪争议,而是读者和屏幕之间的关系。过去,人们是被动吸收信息。现在,浏览器可能会不断提醒你,眼前这些顺滑、正确、体面的文字,未必出自某个真实的人。它会标出哪些账号在持续生产 AI 内容,也会把一个更难忽视的事实顶到用户面前,互联网上的“自动写作”已经多到很难假装看不见。

检测工具当然不是裁判终局。任何 AI 检测系统都不可能百分之百准确,尤其当越来越多文本本来就是“人机共写”时,边界只会变得更模糊。但 Pangram 这次把检测嵌进日常浏览流程,确实踩中了一个现实痛点。今天的网络内容生产,已经不是“有没有 AI 参与”的问题,而是“AI 参与到什么程度,读者有没有知情权”的问题。