去年 12 月,Google 首次向受信任的测试者开放了 Gemini 2.0 Flash 的原生图像生成功能。而现在,这项功能正式面向所有受支持地区的开发者开放,让大家可以在 Google AI Studio 或 Gemini API 中体验这一创新技术。

Gemini 2.0 Flash:文本 + 图像的多模态 AI

相比传统 AI 只能处理文字或图片,Gemini 2.0 Flash 具备多模态能力,可以同时理解文本、图像,并结合强大的推理能力生成视觉内容。这意味着,它不仅能根据文字生成图片,还能在对话过程中持续优化图像,甚至能结合世界知识,确保生成的内容更加真实、合理。

Gemini 2.0 Flash 的原生图像生成的典型应用场景

1. AI 自动配图,让故事“跃然纸上”

你可以让 Gemini 2.0 Flash 讲述一个故事,它会自动生成风格统一的插图,确保人物形象和场景保持一致。而且,你可以随时调整,比如更改画风或修改某个场景的细节,AI 都能即时响应。

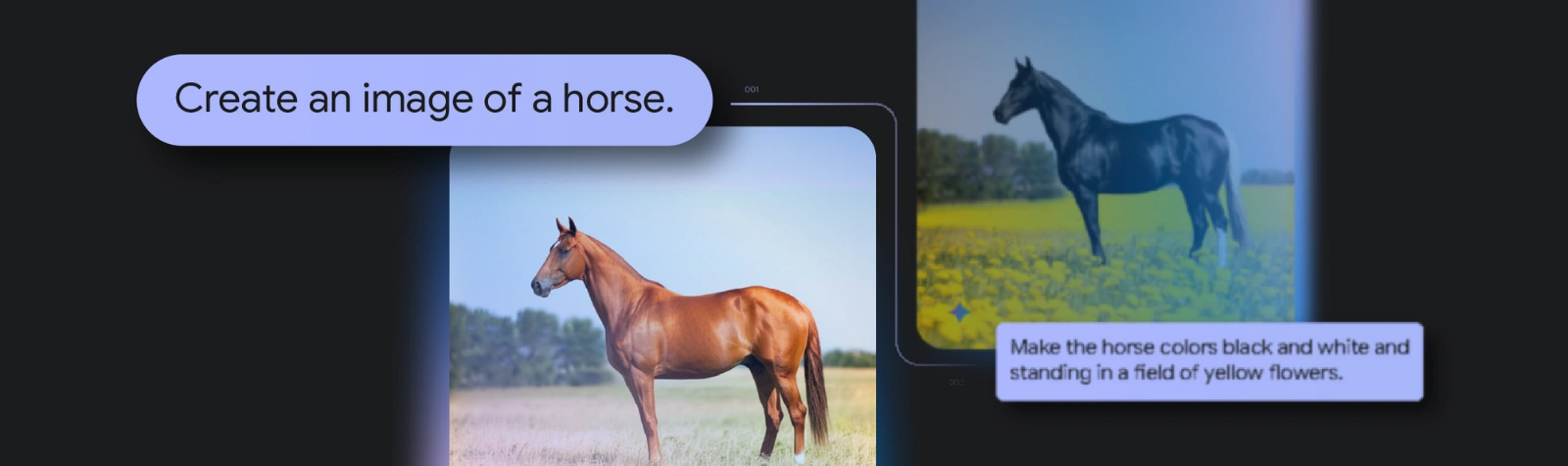

2. 对话式图像编辑,实时调整细节

普通的 AI 生成图片后就无法修改,但 Gemini 2.0 Flash 可以像一个智能设计师一样,在对话中不断调整图像。比如,你可以先让它生成一张图片,然后告诉它:“把背景换成夜晚”、“让主角微笑一点” 它都会理解你的需求,并立即调整。

3. 结合世界知识,智能生成“正确”的图片

与一些仅靠模式匹配生成图像的 AI 不同,Gemini 2.0 Flash 具备一定的常识推理能力。比如,你让它绘制一道菜的插图,它不仅能画出精美的美食,还能确保食材和烹饪步骤符合现实,而不会出现“鱼香肉丝里加整条鱼” 这种低级错误。不过需要注意,尽管它的知识覆盖面广,但仍然不可能做到 100% 准确,因此在专业领域使用时仍需谨慎验证。

4. 文字渲染更精准,适用于广告和社交媒体

很多 AI 生成的图像在文字渲染上表现不佳,字体往往会变形、错位,甚至拼写错误。而 Gemini 2.0 Flash 经过优化,能更准确地在图像中呈现完整的文本,适用于广告设计、社交媒体海报,甚至是电子请柬。

如何体验 Gemini 2.0 Flash?

如果你是开发者,现在就可以通过 Gemini API 开始尝试这项新功能。例如,以下是一个 Python 示例代码,展示如何使用 Gemini 2.0 Flash 生成带插图的故事:

from google import genai

from google.genai import types

client = genai.Client(api_key="GEMINI_API_KEY")

response = client.models.generate_content(

model="gemini-2.0-flash-exp",

contents=(

"生成一个关于可爱小海龟的 3D 数字艺术风格故事。"

"每个场景都生成一张配图。"

),

config=types.GenerateContentConfig(

response_modalities=["Text", "Image"]

),

)

Gemini 2.0 Flash 的意义:AI 生成内容的新里程碑

无论是开发智能 AI 助手、设计互动故事,还是在对话中进行创意头脑风暴,Gemini 2.0 Flash 都让文字和图像的生成变得更加自然流畅。Google 也表示,希望开发者们多多尝试,并提供反馈,帮助他们进一步优化,让这项技术早日进入正式生产版本。

评论(0)