DeepSeek-R1 作为一款免费开源、推理能力比肩 OpenAI-o1 的国产大模型,一经发布便引爆整个互联网。然而,由于访问量巨大,服务器偶尔会面临延迟甚至宕机的问题。其实,我们可以通过 Ollama 将 DeepSeek-R1 安装在本地电脑,这样无需依赖网络连接,也能轻松使用 DeepSeek-R1 生成各种文本和代码。

硬件要求

处理器(CPU)

至少需要具备 4 核及以上 的处理器,主频不低于 2.5 GHz。更高性能的CPU能够加快模型的的推理速度。

内存(RAM)

- 1.5B参数模型:最低需要约 4 G RAM。

- 7B参数模型:建议至少 8-10 G RAM。

- 更大参数模型(如 70B 或 671B):需要更高的内存,通常需要 40 G 或更多。

显卡(GPU)

对于希望使用 GPU 加速的用户,建议使用支持 CUDA 的 NVIDIA 显卡。例如:

- 集成显卡(如 NVIDIA GTX 1050)适合简单任务。

- 独立显卡(如 NVIDIA GTX 1660或更好)适合中等任务。

- 高端显卡(如 NVIDIA RTX 3090或更高)适合复杂任务。

硬盘空间

至少需要预留 10 GB 的可用硬盘空间(安装 671b 需需预留 450 G 硬盘空间),用于存储模型文件、数据以及相关依赖库。

安装步骤

整个安装过程需 10-15 分钟!

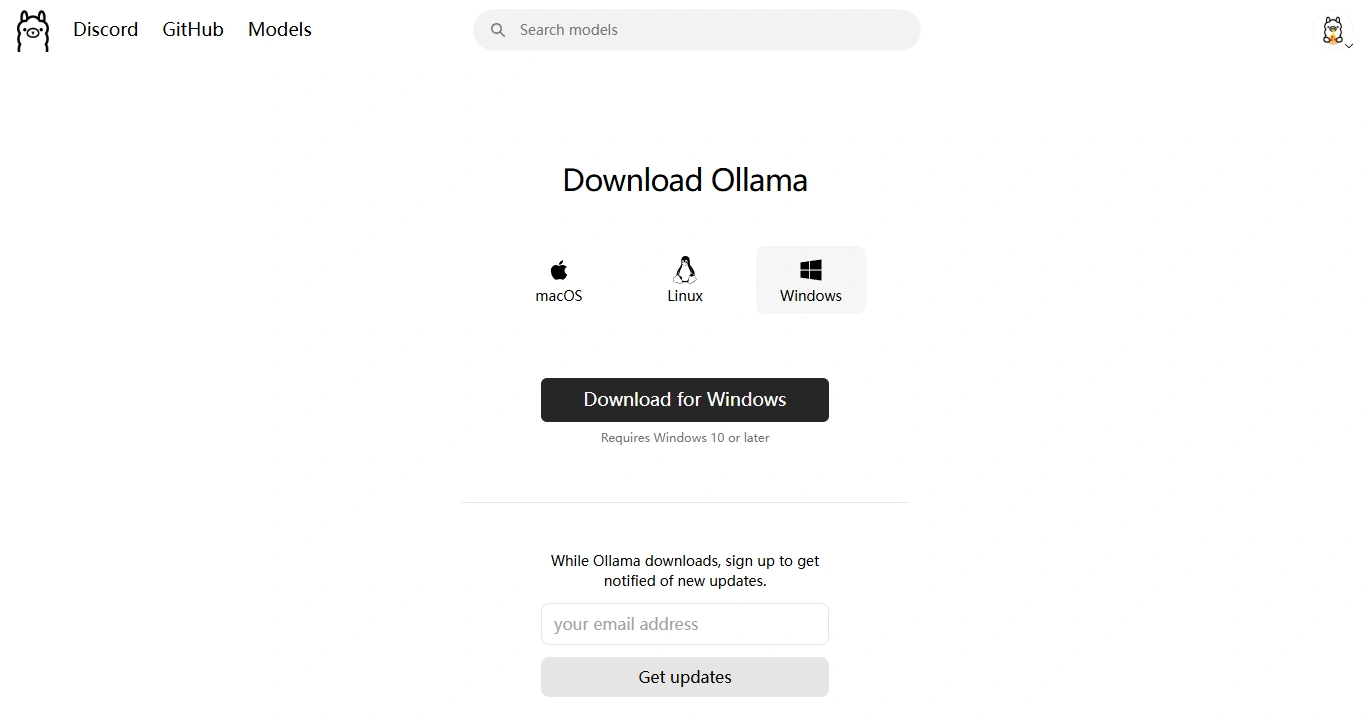

下载 Ollama 安装文件

访问 https://ollama.com/download 下载 Ollama 安装文件。

Ollama 支持 MacOS、Linux 和 Windows 三款操作系统,接下来的安装以 Windows 为例。

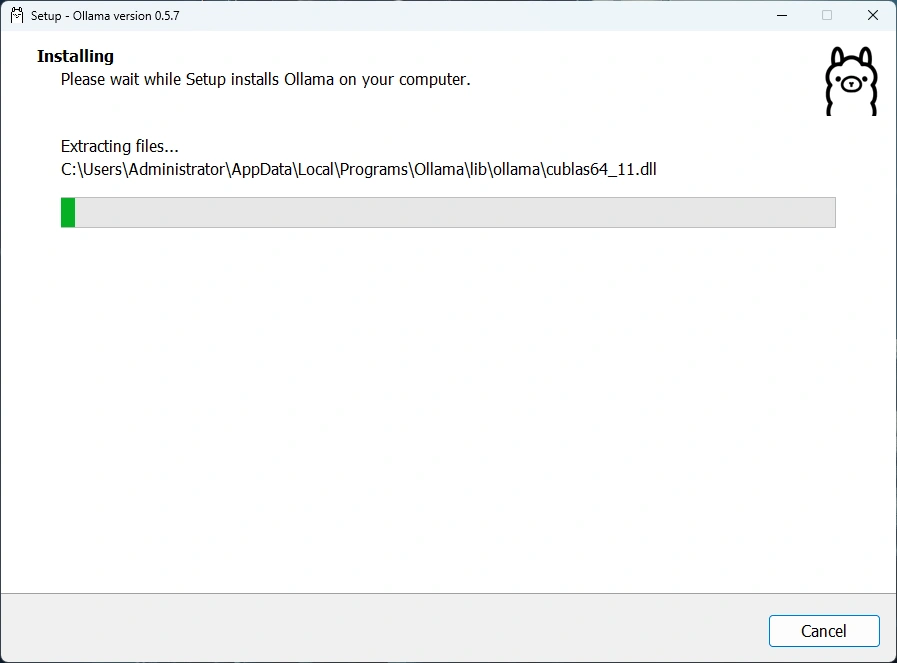

安装 Ollama

根据 Ollama 默认安装要求进行安装,无需做任何其他设置与操作。

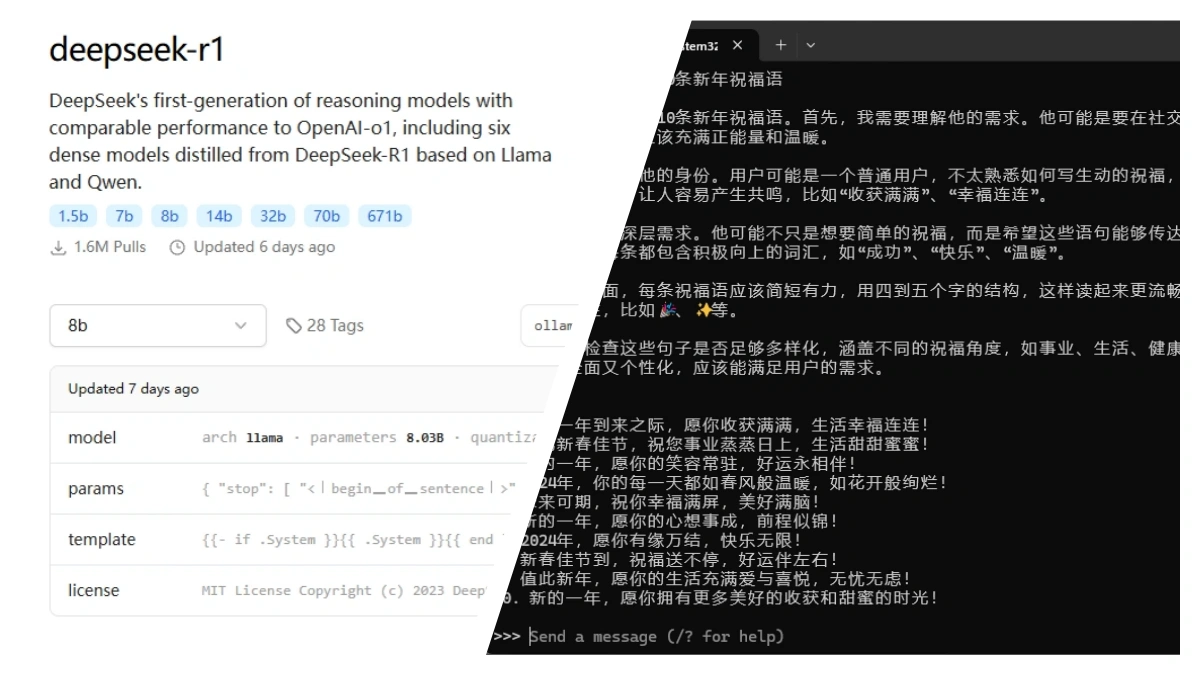

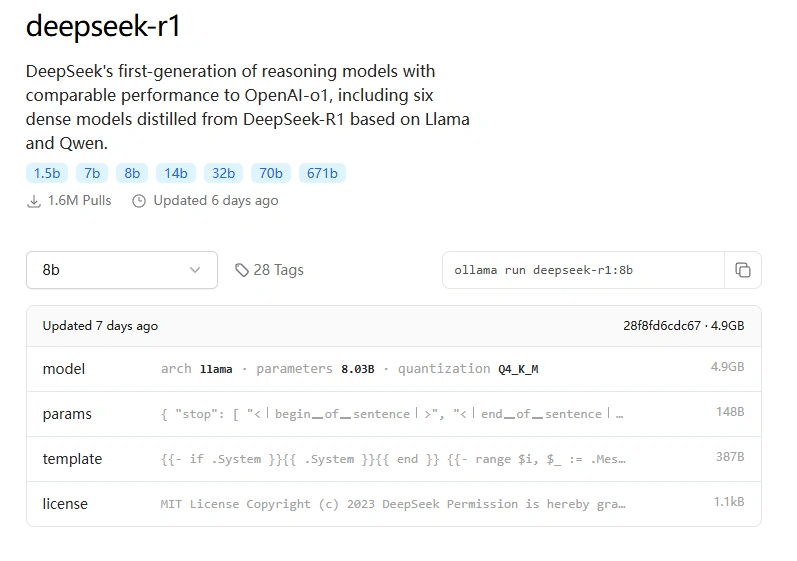

选择 DeepSeek 模型版本

访问 https://ollama.com/library/deepseek-r1 根据你的机器配置和功能需求选择需要安装的 DeepSeek R1 的版本。

| 模型版本 | 参数数量 | 主要特点 | 性能表现 |

|---|---|---|---|

| DeepSeek R1 | 70B | 完整的高性能模型,支持长链推理和强化学习训练。 | 在数学、代码编写和自然语言推理等任务上表现优异,接近 OpenAI 的 o1。 |

| DeepSeek R1-Distill-32B | 32B | 蒸馏版模型,旨在提高效率,适合资源有限的环境。 | 在数学和代码任务上与 OpenAI o1-mini 相当,性能优于 GPT-4o 和 Claude 3.5 Sonnet。 |

| DeepSeek R1-Distill-14B | 14B | 较小的蒸馏版,进一步优化了计算资源的使用。 | 性能较 32B 版本略低,但仍具备良好的推理能力。 |

| DeepSeek R1-Distill-8B | 8B | 更小的蒸馏版,适合对延迟和资源有严格要求的应用场景。 | 性能下降明显,适合轻量级应用。 |

| DeepSeek R1-Distill-7B | 7B | 小型蒸馏模型,进一步降低了计算需求。 | 在特定任务上的表现不如更大模型,但仍可用于基础应用。 |

| DeepSeek R1-Distill-1.5B | 1.5B | 最小的蒸馏版本,适合极为资源受限的环境。 | 性能最弱,但对于简单任务仍然有效。 |

通过 Ollama 安装 DeepSeek-R1

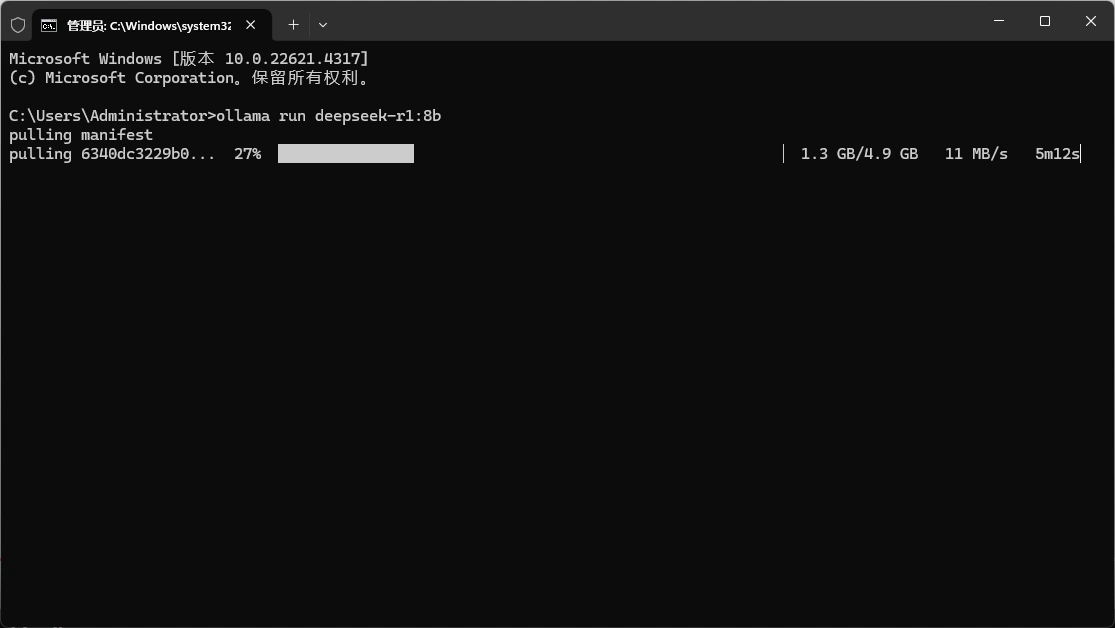

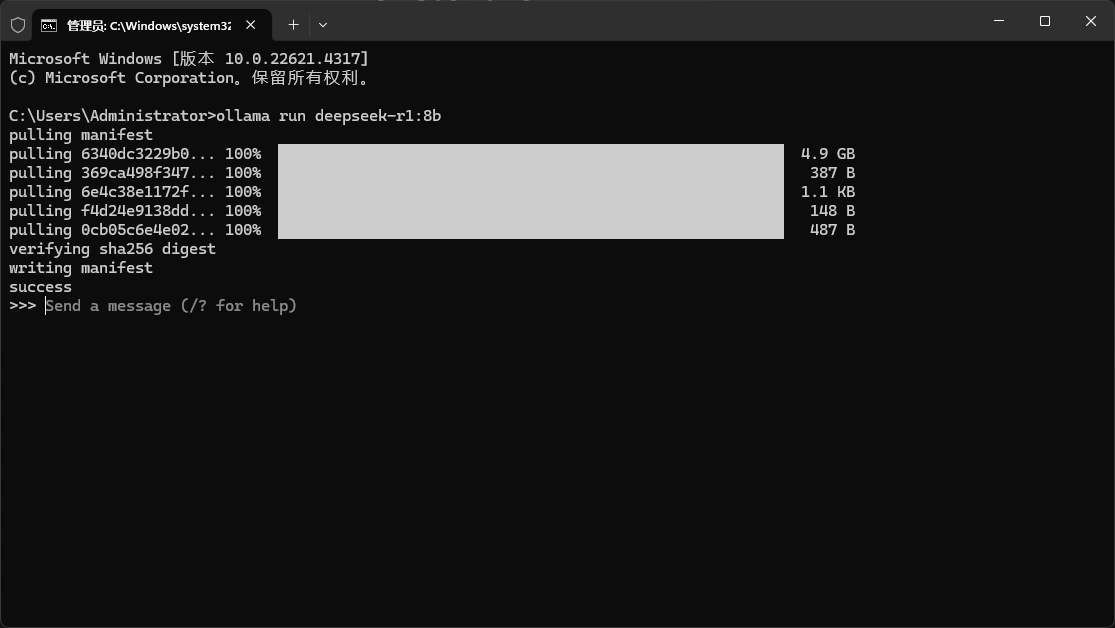

启动 Ollama(Ollama 图标将出现在系统托盘),打开 Windows 命令提示符窗口或 Powershell 窗口。输入需要安装的 DeepSeek-R1 模型版本的执行命令。首次执行,Ollama 会自动下载模型并进行安装。

例如,安装 DeepSeek-R1 8B 模型,运行以下命令行即可。

ollama run deepseek-r1:8b

运行 DeepSeek-R1

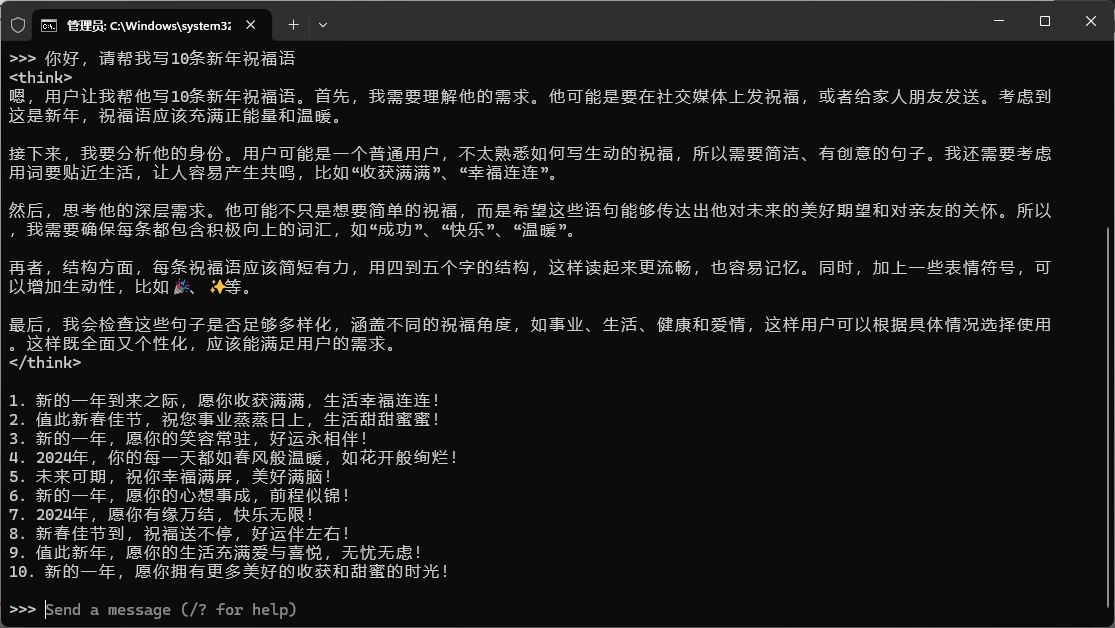

安装完毕后就可以在命令提示符窗口和 DeepSeek-R1 聊天了。 <think></think> 之间的内容是模型的思考过程,之后的内容是模型的回答结果。

Ollama 安装程序(百度网盘下载)

如果在 Ollama 官网下载安装程序时遇到问题,也可以通过百度网盘获取安装文件。

链接: https://pan.baidu.com/s/14zKwFEH_Z9g5HBptgf10Lg?pwd=ft2i

提取码: ft2i

评论(4)

文件下载不了

哪一个文件?如果是 Ollama 的安装文件,也可以通过文章底部的百度网盘下载!

为什么安装 DeepSeek-R1很慢

哪一步慢了?